ニュース概要:

- NVIDIA BlueField-4 は、ギガスケール推論向けに設計された新しい種類の AI ネイティブ ストレージ インフラである NVIDIA Inference Context Memory Storage Platform に搭載され、エージェント型 AI の高速化とスケーリングを実現

- 新しいストレージ プロセッサ プラットフォームは、超高速の長期記憶と短期記憶を備えたロング コンテキスト処理エージェント型 AI システム向けに設計

- 推論コンテキスト メモリ ストレージ プラットフォームは、AI エージェントの長期記憶を拡張し、ラックスケール AI システムのクラスター間における高帯域幅のコンテキスト共有を可能にし、1 秒あたりのトークン処理数と電力効率を最大 5 倍向上

- NVIDIA Spectrum-X Ethernet により実現されるマルチターン AI エージェント向けの拡張コンテキスト メモリは、応答性を向上させ、GPU あたりのスループットを強化し、エージェント型推論の効率的なスケーリングをサポート

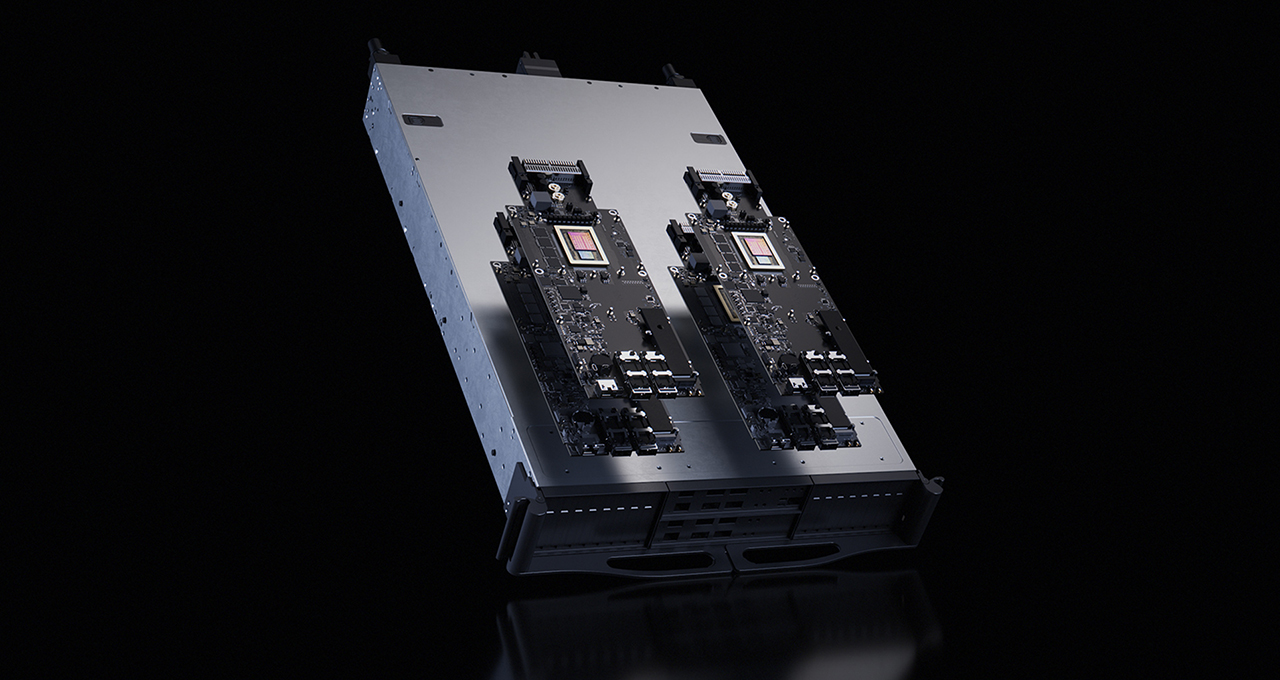

【プレス リリース】ラスベガス — CES — 2026 年 1 月 5 日 — NVIDIA は本日、フルスタック NVIDIA BlueFieldプラットフォームの一部である NVIDIA BlueField®-4 データ プロセッサが、次世代 AI フロンティア向けの新たな AI ネイティブ ストレージ インフラである NVIDIA Inference Context Memory Storage Platform に搭載されることを発表しました。

AI モデルが数兆のパラメータと多段階推論にまで拡張されるにつれて、膨大な量のコンテキスト データが生成されます。これはキーバリュー (KV) キャッシュで表され、精度、ユーザー体験、継続性にとって極めて重要です。

KV キャッシュを GPU に長期保存することはできません。マルチエージェント システムでのリアルタイム推論のボトルネックが発生する可能性があるためです。 AI ネイティブ アプリケーションには、このデータを保存および共有するための新たな種類のスケーラブルなインフラが必要です。

NVIDIA Inference Context Memory Storage Platform は、GPU メモリ容量を拡張し、ノード間での高速共有を可能にし、従来のストレージと比較で 1 秒あたりのトークン数を最大 5 倍に増強し、最大 5 倍の電力効率を実現するコンテキスト メモリのインフラを提供します。

NVIDIA の創業者/ CEO である ジェンスン フアン(Jensen Huang) は、次のように述べています。「AI はコンピューティング スタック全体を変革し、そして今度はストレージに革命をもたらします。AIはもはや単発のチャットボットではなく、現実世界を理解し、長期的な視点で推論を行い、事実に基づいて行動し続け、ツールを使用して実際の作業をこなし、短期記憶と長期記憶の両方を保持する知的なパートナーになりつつあります。BlueField-4 を活用して、NVIDIA とそのソフトウェアおよびハードウェア パートナーは、AI の次世代フロンティア向けにストレージ スタックを再構築します。」

NVIDIA Inference Context Memory Storage Platform では、KV キャッシュ容量を拡大し、ラックスケール AI システムのクラスター間でのコンテキスト共有を加速します。マルチターン AI エージェント向けの永続的なコンテキストにより、応答性を向上させ、AI ファクトリのスループットを強化し、長コンテキストのマルチエージェント推論の効率的なスケーリングをサポートします。

NVIDIA BlueField-4 搭載プラットフォームの主な機能は、以下の通りです。

- NVIDIA Rubin クラスターレベルの KV キャッシュ容量は、ロング コンテキスト、マルチターンのエージェント型推論に必要なスケールと効率を実現

- 従来のストレージと比較して最大 5 倍の電力効率を実現

- NVIDIA DOCA™ フレームワークにより実現され、NVIDIA NIXL ライブラリおよび NVIDIA Dynamo ソフトウェアと緊密に統合された AI ノード間で KV キャッシュのスマートな高速共有により、1 秒あたりのトークン数を最大化し、最初のトークン生成までにかかる時間を短縮し、マルチターン応答性を向上

- NVIDIA BlueField-4 で管理されるハードウェア アクセラレーション対応の KV キャッシュ配置により、メタデータのオーバーヘッドを排除し、データ移動を削減し、また、GPU ノードからの安全で分離されたアクセスを保証

- NVIDIA Spectrum-X™ Ethernet により実現される効率的なデータ共有と検索が、AI ネイティブ KV キャッシュへの RDMA ベースのアクセスをサポートする高性能ネットワーク ファブリックとして機能

AIC、Cloudian、DDN、Dell Technologies、HPE、Hitachi Vantara、IBM、Nutanix、Pure Storage、Supermicro、VAST Data、WEKA などのストレージ イノベーターが、BlueField-4 を搭載した次世代 AI ストレージ プラットフォームをいち早く構築しています。BlueField-4 は 2026 年後半に提供開始予定です。

詳細は、CES における NVIDIA Live をご覧ください。

NVIDIAについて

NVIDIA (NASDAQ: NVDA) はAIとアクセラレーテッド コンピューティングの世界的なリーダーです。

AIがコンピューティングスタック全体とストレージに革命をもたらすこと;AIが単発のチャットボットではなく、物理世界を理解し、長期的な視野で推論し、事実に基づき、ツールを用いて実際の作業を行い、短期記憶と長期記憶の両方を保持する知的な協力者へと進化していること;BlueField-4により、NVIDIAとそのソフトウェアおよびハードウェアパートナーがAIの次なるフロンティアに向けたストレージスタックを再構築していること; NVIDIA の製品、サービス、テクノロジの利点、影響、性能、提供状況に関する記述、NVIDIA の提携企業やパートナーを含む第三者との取り決めに関する期待、技術開発に対する期待、およびその他の歴史的事実ではない記述、また、これらに限定されない記述に関する利点と影響など、本プレス リリースに記載されている記述の中には、1933年証券法第27A条および1934年証券取引法第21E条(いずれも改正済み)に定める将来予測に関する記述に該当し、当該条項により定められた「セーフハーバー」の適用を受けるものであり、実際の結果が予想と著しく異なる原因となるリスクおよび不確実性に影響を受ける可能性があります。実際の結果が大幅に異なる可能性のある重要な要因には、以下のものが含まれます:世界的な経済状況;NVIDIAの製品を製造、組み立て、梱包、テストする第三者への依存;技術開発と競争の影響;新製品や技術の開発または既存製品、技術の改良;NVIDIAの製品またはパートナーの 製品の市場受け入れ状況;設計、製造またはソフトウェアの欠陥;消費者ニーズや需要の変化;業界標準やインターフェースの変更;NVIDIAの製品または技術がシステムに統合された際の予期せぬパフォーマンスにより生じる損失などを含み、NVIDIAが証券取引委員会(SEC)に提出する最新の報告書(年次報告書Form 10-Kおよび四半期報告書Form 10-Qを含むがこれらに限定されない)において随時開示されるその他の要因です。SECに提出された報告書は、NVIDIAのウェブサイトに掲載されており、NVIDIAから無償で入手可能です。これらの将来予測に関する記述は、将来の業績を保証するものではなく、本資料の発表現在時点での状況に基づくものであり、法律で義務付けられる場合を除き、NVIDIAは、将来の出来事や状況の変化を反映のためにこれらの将来予測に関する記述を更新する義務を負いません。

© 2026 NVIDIA Corporation. 無断複写、複製、転載禁止。 NVIDIA、NVIDIA ロゴ、BlueField、NVIDIA DOCA、NVIDIA Spectrum-X は米国およびその他の国における NVIDIA Corporation の商標または登録商標です。その他の社名と製品名は、それらが関連付けられている企業の商標である可能性があります。機能、価格、販売状況、仕様は、予告なしに変更される場合があります。