AI エージェントは開発者のワークフローに革命をもたらします。そして、その次のフロンティアはナレッジ ワーク、すなわち情報処理、複雑な問題解決、新しいアイデアの創出、そしてイノベーションの推進です。

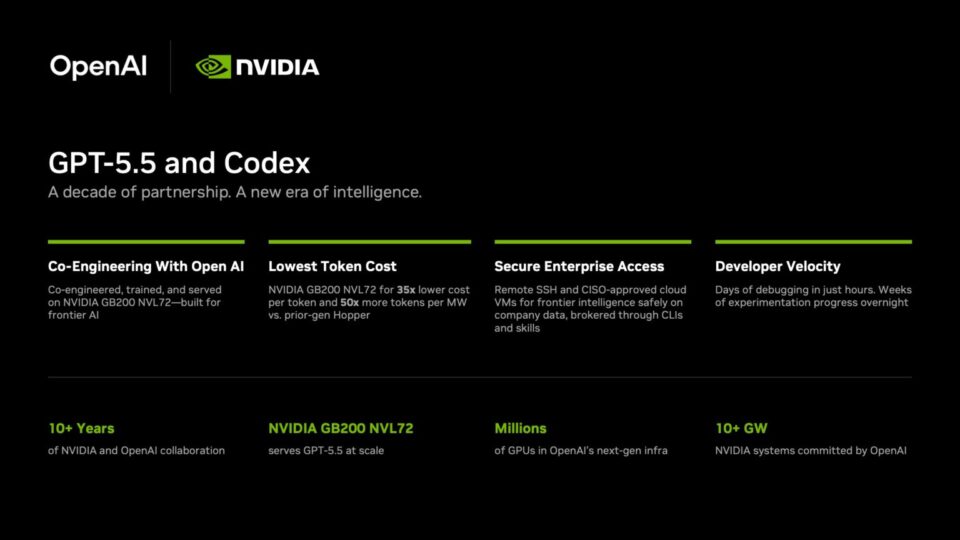

OpenAI のエージェント型コーディング アプリケーションである Codex は、この新たなフロンティアを実現します。Codex は、NVIDIA GB200 NVL72 ラックスケール システム上で動作する OpenAI の最先端モデルである GPT-5.5 によって駆動しています。

エンジニアリング、製品開発、法務、マーケティング、財務、営業、人事、運用、開発者プログラムなど、1 万人を超える NVIDIA 社員が既に GPT-5.5 搭載の Codex を活用し、彼らの言葉を借りれば「驚くべき」「人生を変えるような」成果を上げています。

NVIDIA のエンジニアは、Codex アプリを通じて GPT-5.5 に数週間前からアクセスしており、その成果は目に見える形で現れています。GB200 NVL72 上で稼働するこのシステムは、従来世代のシステムと比較して、100 万トークンあたりのコストを 35 分の 1 に、1 メガワットあたりのトークン出力を 50 倍に向上させています。この経済性により、フロンティア モデルの推論をエンタープライズ規模で実現することが可能になりました。

かつて数日かかっていたデバッグ サイクルは数時間に短縮され、以前は数週間を要していた実験も、複雑な複数ファイルからなるコードベースにおいて、一晩で進展するようになっています。チームは、自然言語プロンプトからエンドツーエンドの機能をリリースできるようになり、以前のモデルよりも信頼性が向上し、無駄なリソース消費の削減も実現しています。

OpenAI の目覚ましい進歩は、NVIDIA がフロンティア モデル企業と連携して取り組んでいる最新の事例です。NVIDIA 社内での AI エージェントの利用を加速させるだけでなく、パートナー企業が世界最高水準の、低コストかつ電力効率に優れたモデルをすべての人に提供できるよう支援しています。

NVIDIA の創業者/CEO であるジェンスン フアン (Jensen Huang) は、全従業員に Codex の利用を促すメールの中で、「光速で飛び立とう。AI の時代へようこそ」と呼びかけました。

エンタープライズ セキュリティのために構築された導入環境

人間と同様に、エージェントにはそれぞれ専用のコンピュータが必要です。

安全なエンタープライズ環境内でのシームレスな運用を保証するため、Codex アプリは承認済みのクラウド仮想マシンへのリモート Secure Shell (SSH) 接続をサポートしており、エージェントは外部にデータを公開することなく、実際の企業データを操作できます。

最大限のセキュリティと監査可能性を確保するため、NVIDIA IT は全従業員向けにクラウド仮想マシン (VM) を展開し、エージェントを安全に実行できるようにしました。これにより、エージェントが最大限の能力を発揮できる専用のサンドボックス環境が提供され、同時に完全な監査可能性が維持されます。ユーザーは、クラウド VM 上で動作する Codex エージェントを、全従業員が使い慣れたユーザー インターフェースから制御できます。

NVIDIAの 導入環境はデータ保持ゼロ ポリシーに基づいており、エージェントはコマンドライン インターフェースとスキル (NVIDIA が社内で自動化ワークフローを実行するために使用しているものと同じエージェント ツールキット) を介して、読み取り専用権限で本番システムにアクセスします。

10 年にわたるフルスタック コラボレーション

GPT-5.5 のリリースと Codex の展開は、NVIDIA と OpenAI の 10 年以上にわたる協力関係を象徴するものです。このパートナーシップは 2016 年、フアンが OpenAI のサンフランシスコ本社に最初の NVIDIA DGX-1 AI スーパーコンピューターを手渡しで届けたことから始まりました。

以来、両社は AI スタック全体にわたって緊密に連携してきました。

NVIDIA は、OpenAI の gpt-oss オープンウェイト モデルのリリース当初からのパートナーとして、NVIDIA TensorRT-LLM や vLLM、Ollama などのエコシステム フレームワーク向けにモデルのウェイトを最適化しました。

OpenAI は、次世代 AI インフラ向けに 10 ギガワットを超える NVIDIA システムを導入することを表明しました。この構築により、今後数年にわたり、数百万基の NVIDIA GPU が OpenAI のモデルのトレーニングと推論の基盤となります。

OpenAI と NVIDIA は、初期段階のシリコン開発および共同設計におけるパートナーです。OpenAI は NVIDIA のハードウェア ロードマップ策定に役立つフィードバックを提供し、その見返りとして新しいアーキテクチャへの早期アクセス権を得ています。この関係は、具体的なマイルストーンとして、最初の GB200 NVL72 による 10 万基の GPU クラスタの共同立ち上げを実現しました。このクラスタは複数の大規模なトレーニング実行を完了し、フロンティア規模におけるシステム レベルの信頼性の新たなベンチマークを確立しました。

GPT-5.5 は、このインフラがフル稼働した成果です。

詳細は OpenAI の発表をご覧ください。