従来のデータセンターは、データの保存、取得、処理のみを行っていました。しかし、生成 AI やエージェント型 AI の時代において、データセンターは AI トークンのファクトリーへと進化しました。AI 推論が主要なワークロードとなるにつれ、主に出力されるのはトークンという形で生成されるインテリジェンスとなってきています。

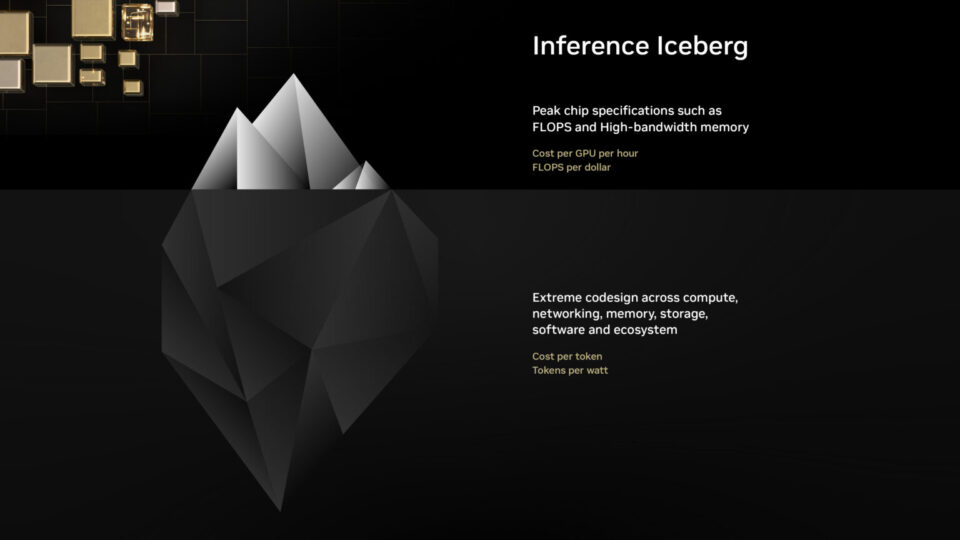

このように変化する中、総所有コスト (TCO) など、AI インフラの経済性を評価する方法も移行する必要が出てきています。AI インフラを評価する企業は依然、ピーク時のチップの仕様、コンピューティング コスト、あるいは 1 ドルあたりの浮動小数点演算回数 (1ドルあたりの FLOPS) といった指標にばかり注目しがちです。

抑えておきたい違いは以下のとおりです。

- コンピューティング コスト:クラウド プロバイダーからレンタルする場合でも、オンプレミスで所有する場合でも、企業が AI インフラに支払う費用のこと

- 1 ドルあたりの FLOPS:企業が 1 ドルあたりに得られる純粋なコンピューティング性能のことで、純粋なコンピューティング性能と実際のトークン出力は同一ではない

- トークンあたりのコスト:提供されるトークン 1 つあたりを生成するための企業の総コストを指し、通常は 100 万トークンあたりのコストを表す

最初の 2 つは単なる入力の指標です。企業は出力に基づいて運営されているのに、入力を最適化するのは根本的に不調和です。

トークンあたりのコストは、企業が AI を収益性高く拡張できるかどうかを決定づける要素です。トークンあたりのコストはハードウェアのパフォーマンス、ソフトウェアの最適化、エコシステムのサポート、そして実際の利用状況を直接考慮した唯一の TCO 指標であり、NVIDIA は業界で最も低いトークンあたりのコストを実現しています。

トークン コストを削減する要因とは

トークン コストを最適化する方法を理解するには、100 万トークンあたりのコストを計算する式を分析する必要があります。

この式において、AI インフラを評価する企業の多くは、分子である GPU あたりの時間単価に注目します。これは、クラウド環境の場合はクラウド プロバイダーに支払う時間単価であり、オンプレミス環境の場合は自社インフラの償却から算出される実質的な時間単価です。しかし、トークン コスト削減の真の鍵は分母にあります。つまり、トークンの出力を最大化することです。

この分母には、ビジネスにおいて 2 つの意味合いがあります。

- トークン コストの最小化: トークン出力量の増加がコスト計算式に反映されると、トークンあたりのコストが下がり、結果として、あらゆるインタラクションにおける利益率が向上します。

- 収益の最大化: 1 秒あたりのトークン出力量が増えると、1 メガワットあたりのトークン数も増加します。これは、AI を活用した製品やサービスに利用できるインテリジェンスが増えるということになり、同じインフラ投資からより多くの収益を生み出すことにつながります。

分子だけに注目すると、分母を動かす要因を見落としてしまうことになります。これを、「推論の氷山モデル」を例に考えてみましょう。分子は水面上にあり、目に見えるため比較しやすい部分です。一方、分母は水面下のすべてであり、現実世界のトークン出力を決定する重要な要素を表しています。AI インフラを正確に評価するには、まずその水面下に何があるのかを問うことから始める必要があります。

- 表面的な調査:

- GPU 1 時間あたりのコストはいくらか?

- ピーク時のペタフロップス性能と高帯域幅メモリ容量はどれくらいか?

- 1 ドルあたりの FLOPS はどれくらいか?

- 詳細なコスト分析:

- 100 万トークンあたりのコストはいくらか? 具体的に言うと、最も広く導入されている AI モデルである、大規模な Mixture-of-Experts (MoE) リーズニング モデルにおける 100 万トークンあたりのコストはいくらか?

- 1 メガワットあたりのトークン出力はいくらか? 土地、電力、インフラへの設備投資が多額になるオンプレミス環境においては特に、1 メガワットあたり生成されるインテリジェンスを最大化することが重要です。

- スケールアップ インターコネクトは、MoE モデルの「全対全通信」トラフィックを処理できるか?

- FP4 精度はサポートされているか? 推論スタックは、高い精度を維持しながら FP4 を利用できるか?

- 推論ランタイムは、ユーザー インタラクティビティを高めるための投機的デコードまたはマルチトークン予測をサポートしているか?

- サービング層は、分離型サービング、KV 対応ルーティング、KV キャッシュ オフロードなどの最適化をサポートしているか?

- プラットフォームは、超低レイテンシ、高スループット、長い入力シーケンス長など、エージェント型 AI 特有のワークロード要件をサポートしているか?

- プラットフォームは、トレーニングからポストトレーニング、大規模推論に至るまで、あらゆるモデル アーキテクチャにおいてライフサイクル全体をサポートし、インフラの汎用性と高い利用率を確保しているか?

これらのアルゴリズム、ハードウェア、ソフトウェアの最適化は、すべてが有効で、かつ統合されていなければならず、そうでなければ分母が破綻してしまいます。安価な GPU であっても、1 秒あたりのトークン生成量が大幅に低ければ、トークンあたりのコストは大幅に高くなります。フルスタック全体にわたって適切な AI インフラを構築することで、すべての最適化が互いに相乗効果を発揮するようになります。

1 ドルあたりの FLOPS よりもトークンあたりのコストの方がはるかに重要な理由とは

DeepSeek-R1 AI モデルに関する以下のデータは、理論上のビジネス成果と実際のビジネス成果の差を明確に表しています。

コンピューティング コストだけを見ると、NVIDIA Blackwell プラットフォームは NVIDIA Hopper の約 2 倍のコストがかかるように見えますが、コンピューティング コストは投資に見合う成果を表すものでは全くありません。1 ドルあたりの FLOPS だけを分析すると、NVIDIA Blackwell は NVIDIA Hopper アーキテクチャに比べて 2 倍高いように見えますが、実際の出力は桁違いに異なります。Blackwell は Hopper よりもワットあたりのトークン出力が 50 倍以上高く、結果として 100 万トークンあたりのコストは約 35 分の 1 に低減されます。

| 指標 | NVIDIA Hopper (HGX H200) | NVIDIA Blackwell (GB300 NVL72) | NVIDIA Blackwell と Hopper の比較 |

|---|---|---|---|

| GPU あたりのコスト/時間 ($) | $1.41 | $2.65 | 2 倍 |

| FLOP/ドル (PFLOPS) | 2.8 | 5.6 | 2 倍 |

| GPU あたりのトークン/秒 | 90 | 6,000 | 65 倍 |

| メガワットあたりのトークン/秒 | 5 万 4 千 | 280 万 | 50 倍 |

| 100 万トークンあたりのコスト ($) | $4.20 | $0.12 | 35 分の 1 |

注 :データは NVIDIA の分析と SemiAnalysis InferenceX v2 ベンチマークに基づいています。

このような大きな差は、NVIDIA Blackwell が以前の Hopper 世代に比べてビジネス価値を大幅に向上させ、システム コストの増加をはるかに上回る効果をもたらしていることの証しです。

最適な AI インフラの選び方

AI インフラをコンピューティング コストや机上の FLOPS/ドルで比較するだけでは不十分であり、推論の経済性を正確に反映しているとは言えません。データが示すように、AI インフラの収益見込みと収益性を正確に評価するには、入力を測る指標から、トークンあたりのコストや生成されるトークン出力へと視点を転換する必要があります。

NVIDIA は、コンピューティング、ネットワーク、メモリ、ストレージ、ソフトウェアのテクノロジやパートナーのテクノロジに至る緊密な協調設計により、業界最低のトークン コストと最高のトークン スループットを実現しています。さらに、NVIDIA プラットフォーム上に構築された vLLM、SGLang、NVIDIA TensorRT-LLM、NVIDIA Dynamo といったオープン ソースの推論ソフトウェアを継続的に最適化することで、既存の NVIDIA インフラでは、トークン取得後もトークン出力は増加し続け、トークンあたりのコストは低下し続けます。

主要なクラウド プロバイダーや NVIDIA クラウド パートナーは、既にこのメリットを大規模に活用しています。CoreWeave、Nebius、Nscale、Together AI などのパートナーは NVIDIA Blackwell インフラを導入済みであり、スタックを最適化することで、企業向けにトークン コストを現在可能な限りの最低水準に抑えています。こうした取り組みにより、あらゆるインタラクションにおいて NVIDIA のハードウェア、ソフトウェア、エコシステムの協調設計によるメリットを最大限に活用できるようになっているのです。

![100 万トークンあたりのコストを計算する式。100 万トークンあたりのコスト = [GPU 1 基あたりの 1 時間あたりのコスト / (GPU 1 基あたりの 1 秒あたりのトークン数 × 60 秒 × 60 分)] × 100 万。](https://blogs.nvidia.co.jp/wp-content/uploads/sites/11/2026/04/inference-equation-token-5115300-1536x864-1-960x540.png)