クラウドAIビデオストリーミング プラットフォームである NVIDIA Maxine が、GAN を使用して帯域幅性能を向上

ミンユウ リュウ (Ming-Yu Liu) とアルン マリヤ (Arun Mallya) がビデオ通話中に、どちらかの音声が途切れ、やがてフリーズしてしまいました。

今回のパンデミックで、私たちのほとんどがこのようなやっかいな現実に直面しています。しかし、リュウとマリヤは私たちとは異なり、この現実に対処することができたのです。

リュウとマリヤは NVIDIA の AI 研究者であり、コンピューター ビジョンのスペシャリストです。彼女たちは同僚のティンチュン ワン (Ting- Chun Wang) の協力の元、ビデオをネット経由で送信するために圧縮、展開する際に一般的に使用される、ビデオ コーデックと呼ばれるソフトウェアの代わりに、ニューラルネットワークを使用できるかもしれないということに気付きました。

彼女たちの取り組みにより、ユーザーが通常必要とする 10 分の 1 のネットワーク帯域幅でのビデオ通話が可能になります。将来的には、帯域幅の消費を桁違いに削減することが期待されています。

マリヤはこう言います。「私たちは、AI を使用したビデオ通信のエクスペリエンスを向上させ、非常に低い帯域幅にしかアクセスできない場合でも、音声通話からビデオ通話にアップグレードできるようにしたいと考えています。」

GANにより接続性が向上

この技術は、発信者が帽子や眼鏡、ヘッドホン、マスクを着けている場合でも機能します。そして、ユーザーに楽しんでもらえるようにオプション機能をデモに盛り込み、ユーザーが髪型や服をデジタルで変更したり、アバターを作成したりできるようにしました。

重要な機能としては、ニューラルネットワークを使用してユーザーの顔の位置を調整することで、より自然な動きに見えるようにしています。発信者はビデオ フィードに目線を合わせていますが、カメラを直接見ているように見えるため、対面でつながっているという感覚が高まります。

「コンピューター ビジョン技術を使用して、人の頭の位置をさまざまな角度から特定できます。この技術により、さらに自然な会話ができるようになると考えています」と、ワンは話しています。

AIがバーチャルライフをよりリアルにする、その最新の方法をのぞいてみましょう。

AI アシストによるビデオ通話の仕組み

AI アシストによるビデオ通話を支えるメカニズムはシンプルです。

送信者はまず、発信者のリファレンス画像を送信します。ここまでは、圧縮ビデオ ストリームを使用する今日の一般的なシステムと同じです。次に、画像全体のピクセルをストリーミングするのではなく、ユーザーの目、鼻、口の周りの重要なポイント数点の位置に関するデータを送信します。

受信者側の敵対的生成ネットワーク (generative adversarial network) では、元の画像と、顔の重要なポイントを使用して、その後の画像をローカル GPU で再構築します。結果的に、ネットワークを経由して送信されるデータは格段に少なくなります。

GAN の分野においてリュウは昨年、誰が描いた落書きでも写実的な芸術作品に変える AI ツールである GauGAN で脚光を浴びました。すでに 100 万超の画像が GauGAN を使用して作られています。GauGAN は AI Playground で利用できます。

リュウは次のように話しています。「今回の取り組みに着手したきっかけとなったのがパンデミックでした。現在では誰もがビデオ会議を行うようになったため、プロバイダーが同時により多くの人々にサービスを提供できるように、帯域幅のボトルネックを緩和する方法を模索しました。」

GPUが帯域幅のボトルネックを解消

このアプローチは、ネットワークのボトルネックを計算タスクにシフトして、ローカルまたはクラウドのリソースでより簡単に対処できるようにするという業界のトレンドの一環です。

NVIDIA のメディア グループの最先端製品部門ディレクターであるアンドリュー ペイジ (Andrew Page) は以下のように述べています。「最近では、多くの企業が帯域幅の問題をコンピューティングの問題に変えたいと考えています。帯域幅を追加するのは難しく、コンピューティングを追加するほうが簡単だからです。」

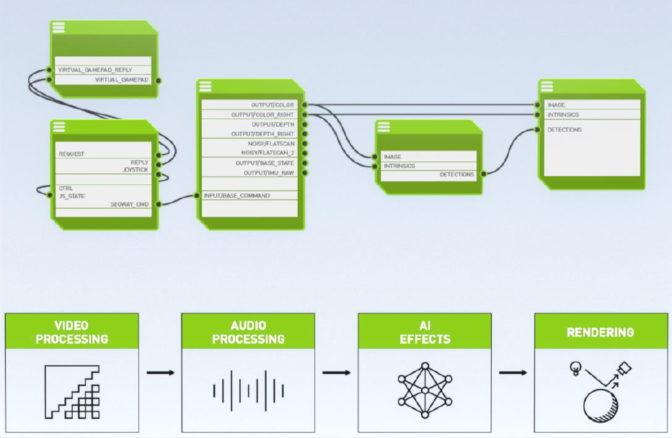

ビデオ サービスに合わせた AI 機器

GAN のビデオ圧縮は、ビデオ会議と通話を強化するクラウド AI ビデオストリーミング プラットフォームである NVIDIA Maxine に搭載されている複数の機能のうちの 1 つです。 オーディオ、ビデオ、対話型 AI 機能がひとつのツールキットにパッケージされ、幅広いデバイスに対応しています。

Maxine は今週開催された GTC で発表されました。Maxine により、サービス プロバイダーはリアルタイムの翻訳、バックグラウンド ノイズの除去、文脈を意識したクローズド キャプションを備えたビデオを、超解像で配信できます。ユーザーは、顔の位置合わせ、仮想アシスタントのサポート、アバターによるリアルなアニメーションなどの機能を享受できます。

ペイジはこう語ります。「ビデオ会議は復興期を迎えています。パンデミックを経験する中で私たちは皆困難を乗り越えてきました。しかし、私たちは視覚に頼って生きる存在ですから、ビデオは今後も生活の一部として生き残っていくでしょう。」

Maxine は、 NVIDIA Jarvis (音声機能やテキスト機能のスイートを提供する対話型 AI 向けの SDK) などのソフトウェアを実行する Tensorコア を搭載した NVIDIA GPU の能力を活用しています。これらの機能が合わさることで、現在でも役立ち、将来のビデオ製品やビデオ サービスのビルディング ブロックとして機能する AI 機能がもたらされます。

NVIDIA Research の詳細については、こちらをご覧ください。また、NVIDIA の CEO であるジェンスン フアン (Jensen Huang) が GTC の中で新着情報の概説を行った様子を、下の動画でご覧いただけます。

(※この動画は日本語字幕をご利用いただけます。)

※NVIDIA Jarvis の名称は 2021 年 7 月に NVIDIA Riva に変更されました。