物理ベースのセンサー シミュレーションが、現実世界のデータ課題を解決するためのアプローチを実現

現実とシミュレーションとの間のギャップが縮小されつつあります。

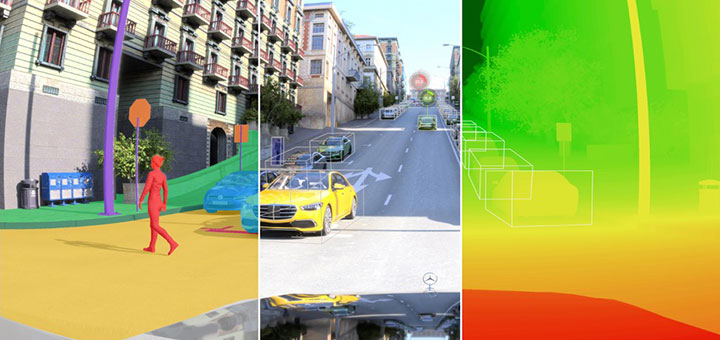

GTC の基調講演の中で、NVIDIA の創業者/CEO であるジェンスン フアン (Jensen Huang) はNVIDIA Omniverse Replicator を発表しました。これはAI ネットワークのトレーニングにおいて、グラウンド トゥルースとなる合成データを生成するためのエンジンです。フアンは、DRIVE Sim を利用して自律走行車 (AV) 開発に応用した場合の Omniverse Replicator の性能をデモで紹介しました。

DRIVE Sim は、Omniverse を基盤に構築されたシミュレーション ツールであり、このプラットフォームの多くの機能を活用しています。DRIVE Sim によって生成されたデータは、自律走行車の認識システムを形成するディープ ニューラルネットワーク (DNN) のトレーニングに利用されます。NVIDIA DRIVE チームにとって、合成データはAV 開発ワークフローに効果的で重要な要素となっています。

自律走行車の認識機能を強化するディープ ニューラルネットワークは、アルゴリズム モデルと、そのモデルのトレーニングのためのデータという 2 つの要素で構成されます。エンジニアたちは、アルゴリズムの改良に多大な時間を費やしています。しかし、実環境のデータ量は収集に時間とコストがかかるうえに不完全であり、これにより、データ量は制限され、依然として不足しています。

こうした不均衡がしばしば DNN 開発の停滞を招き、データがモデルの需要を満たせず、進歩の妨げとなることがあります。合成データを生成することで、開発者はデータの開発をよりしっかりとコントロールし、それをモデルの特定のニーズに合わせることができます。

実環境データは、AV のトレーニング、テスト、および検証のための不可欠な構成要素ではありますが、重大な課題も生み出しています。ネットワークのトレーニングに使用されるデータは、現実世界を走行中の車両に搭載されたセンサーによって収集されます。データを収集した後は、そのデータはグラウンド トゥルースとしてラベル付けされなければなりません。ラベル付けは何千人もの人の手によって行われ、このプロセスには時間とコストがかかる上に潜在的な不正確さが伴います。

合成データで実環境のデータ収集を補うことにより、こうした障害が取り除かれると同時に、エンジニアがてデータ主導型のアプローチを用いて DNN 開発を行い、AV 開発を大幅に加速させるとともに現実世界での成果を向上させることができます。

シミュレーション領域と現実領域とのギャップの問題

合成データの生成は、AI のトレーニング用の広く知られたツールです。2016 年の時点から、研究者たちは『Grand Theft Auto』などのビデオ ゲームを使ってデータを生成する実験を行っています。

しかしビデオ ゲームとは異なり、認識 DNN の品質は現実世界に対するデータの忠実度によって大きく影響されます。物理世界に転換できないデータセットでのトレーニングは、実際にはネットワークのパフォーマンスを低下させる可能性があります。

こうしたシミュレーションと現実とのギャップは、主に 2 つの形で現れます。外観上のギャップは、シミュレートされた画像と実際の画像との間の画素レベルの差異に相当するもので、シミュレーターがどのようにデータを生成するかによって生じます。レンダラー、センサー モデル、3D アセットの忠実度、およびマテリアル特性が、いずれもその一因となり得ます。

コンテンツのギャップは、現実世界のコンテンツの多様性の欠如や、シミュレーションと現実世界とのコンテキストの差異によって生じ得ます。こうした不一致は、シーンのコンテキストが現実と一致しないときに発生します。例えば、現実世界には、ぬかるんだ道路、傷ついた自動車、および道路脇の緊急車両がありますが、これらはいずれもシミュレーションにおいて再現されなければなりません。もう 1 つの重要な要因は、交通や歩行者といったアクターの行動であり、現実的な相互作用が現実的なデータ出力の鍵になります。

Omniverse Replicator を利用してシミュレーション領域と現実領域とのギャップを縮小

Omniverse Replicator は、外観上およびコンテンツのギャップを縮小するように設計されています。

外観上のギャップを縮小するために、DRIVE Sim は Omniverse の RTX パストレーシング レンダラーを利用して、カメラ、レーダーおよびLiDAR、ならびに超音波センサーなどの物理ベースのセンサー データを生成します。LED のフリッカー、モーション ブラー、ローリング シャッター、LiDARビームの広がり、ドップラー効果といった現象を含めた、 現実世界の効果がセンサー データに取り込まれます。こうした詳細には、高忠実度の車両動力学も含まれます。例えばLiDAR スキャン中の車両の動きは、結果として得られる点群に影響を与えるため重要な要素です。

また、センサー データにおいて極めて重要な要素はマテリアルです。DRIVE Sim では、正確なビーム反射のためにマテリアルが物理的にシミュレーションされます。DRIVE Sim には、LiDARマテリアル ライブラリが内蔵されており、まもなくレーダーおよび超音波のマテリアル ライブラリも組み込まれます。

DRIVE Sim のセンサー機能には、モーション ブラー、LED フリッカー、ローリング シャッター、ドップラー効果といった現実世界の効果を取り込む、パストレーシングによるカメラ、レーダーおよびLiDAR モデルが含まれています。

DRIVE Sim のセンサー機能には、モーション ブラー、LED フリッカー、ローリング シャッター、ドップラー効果といった現実世界の効果を取り込む、パストレーシングによるカメラ、レーダーおよびLiDAR モデルが含まれています。コンテンツのギャップに取り組むための主要な方法の 1 つは、最高レベルの忠実度でより多様なアセットを利用するというものです。DRIVE Sim は Omniverse の機能を活用して、幅広いコンテンツ制作ツールと接続されます。ただし、適切なシーンを生成するには、正しいコンテキストであることも必要になります。

Omniverse Replicator はドメイン ランダム化と呼ばれる機能を利用して、迅速にシーンを操作するためにデータを整理します。DRIVE Sim にはこれとシーン構築のためのツールが含まれており、現実世界のコンテキストを維持したまま大量の多様なデータを作成することができます。また Omniverse Replicator は時間精度が高く、動作が予測可能でもあるため、データセットを再現可能な方法で作成することができます。

実際の成果

DRIVE Sim は、すでに NVIDIAで合成データにて認識機能の開発を加速し、大きな成果を上げています。

その一例が、最新の NVIDIA DRIVE Hyperion センサー セットへの移行です。NVIDIA DRIVE Hyperion 8 プラットフォームには、量産対応の AV 開発のためのセンサーが搭載されています。しかし、それらのセンサーが利用可能になる前から、NVIDIA DRIVE チームは合成データを利用して、このプラットフォーム用に DNN を拡張させることができました。DRIVE Sim により、トレーニング用の何百万もの画像とグラウンド トゥルース データが生成されました。その結果、センサーが装備され次第、いつでもネットワークを展開できる準備が整い、何カ月もの貴重な開発時間が節減されました。

別の例としてPathNet DNNが挙げられます。走行可能な車線スペースを検知する PathNet DNN は、車両が車線の中央にいない場合における進路の決定が困難でした。部分的に車線からはみ出して走行することは危険である (なおかつ NVIDIA のデータ収集ポリシーに反する) ため、そのようなデータの収集は困難です。しかし、中心から外れた走行経路の何百万にも及ぶ合成画像でネットワークをトレーニングすることにより、DRIVE Sim は PathNet の精度を大幅に向上させました。

信号機を検知する LightNet と、道路標識を検知して分類する SignNet の双方についても、同様の成果がありました。これらのネットワークは、データ不足のために、極端な角度での信号機の識別に悪戦苦闘したり、特定の条件下において標識を誤分類したりしていました。エンジニアは、現実世界のデータセットを拡張してパフォーマンスを向上させるためのデータを設計することができました。

これらの問題領域を網羅した合成データで双方の DNN をトレーニングすることにより、たちどころにパフォーマンスが向上し、開発プロセスから障害が取り除かれました。

人間にできないことに注目

合成データにより、DNN 開発の性質が変わります。合成データは時間およびコスト効率が高く、またエンジニアにオンデマンドで状況に合わせたデータセットを生成する自由をもたらします。

開発者は、天候、照明、歩行者、路上落下物といった要素を指定することができます。また開発者は、既定のデータセットにおけるトラック、バス、乗用車、およびオートバイの特定の組み合わせを指定するなど、要素の配分をコントロールすることもできます。

合成データは、人間にはラベル付けができないグラウンド トゥルースを提供します。その例には、深度情報、速度、マルチセンサー トラッキングなどがあります。こうしたグラウンド トゥルース情報によって、認識機能の大幅な強化が可能になります。

またこれにより、ラベル付けが困難で時として不可能な構成要素に対するラベル付けも容易になります。例えば、車両の背後を歩いている歩行者は、遮られている間は人間が適切にラベル付けすることは不可能です。しかしシミュレーションにより、たとえ情報が人間には見えなくても、自動的にグラウンド トゥルースが得られ、それは画素レベルで正確なものになります。

前方進路を明瞭化

合成データ生成のためのオープンで拡張可能なモジュール式プラットフォームの Omniverse Replicator は、ディープラーニングのエンジニアに強力な新機能をもたらします。DRIVE Sim はそれらの新機能を利用して、AV 開発者にシミュレーション テストにおける究極の柔軟性と効率性を提供します。

これによってエンジニアは、各自の作業を加速させるために必要なデータセットを作成できるようになります。

その結果が、より正確でより短期間に開発される DNN であり、これにより、より安全で効率的な自動運転技術がより早く路上にもたらされます。

DRIVE Sim についてさらに詳しく学び、より安全で効率的な輸送手段の開発を今すぐに加速させましょう。

GTCの基調講演のリプレイは、こちらからご視聴いただけます。