Cat 306 CR ミニショベルは、重量が 8 トン弱で、標準的な輸送コンテナに収まります。建物の基礎まわりの配管溝掘削や、住宅密集地での地下室掘削など、現場が手狭なときに建設業者がレンタルするものです。

その操縦室は電話ボックスほどの大きさです。オペレーターは操作系のすぐそばに座り、2 本のジョイスティックを使って、左右の手でそれぞれ複数の機能を操作します。操作の習得には時間がかかり、手早く扱えるようになるにはさらに時間がかかります。

今年初めの CES では、この機械が人からの質問に答える様子が披露されました。

デモでは、Cat AI Assistant が NVIDIA Jetson Thor 上で動作しました。Thor は、産業システムやロボティック システムにおけるリアルタイム推論向けに構築されたエッジ AI プラットフォームで、NVIDIA Nemotron 音声モデルが、高速かつ正確な自然な音声対話に使用されています。また、vLLM を介してローカルで提供される Qwen3 4B は、クラウド接続を必要とせず、低レイテンシでリクエストを解釈し、応答を生成します。

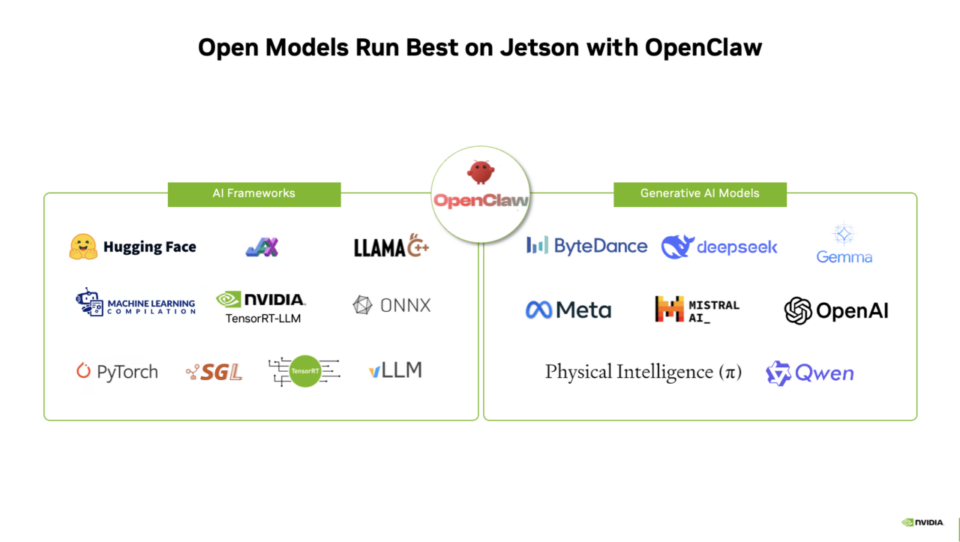

オープン モデルは、企業のイノベーションだけでなく、開発者が自由に構築や実験を行うための新たな可能性も切り開きます。NVIDIA Jetson 上で OpenClaw を実行することで、開発者は API のコストをかけることなく、完全なデータ プライバシーを確保しながら、エッジで常時稼働するプライベートな AI アシスタントを構築できます。

Jetson 開発キットはすべて OpenClaw をサポートしており、20 億パラメータから 300 億パラメータまでのオープン モデルを柔軟に切り替えて使用できます。最先端クラスの AI アシスタントをローカルで実行することで、ユーザーは朝のブリーフィング、日常業務の自動化、コードのレビュー、スマート ホーム システムの制御などをすべてリアルタイムで行えます。

クラウドからエッジへ

オープン モデルはこれまで、最も運用しやすい場所で稼働してきました。

それはデータ センターです。オープン モデルは、拡張性の高いコンピューティングと常時接続のネットワークに支えられた環境で稼働してきました。クラウドでの導入には、レイテンシや継続的なコンピューティング コストが伴い、その負担はクエリのたびに増加します。

一方、物理的なシステムでは、求められるものが異なります。まず、機械が人や環境と相互作用するため、低レイテンシでの動作が求められます。次に、デバイスに厳しい制約があるため、低消費電力で稼働することが求められます。そして、ばらつきがリスクにつながるため、安定した挙動が求められます。

供給面の課題もあります。メモリ不足が業界全体のコスト上昇を招いています。Jetson は、コンピューティングとメモリをシステム オン モジュール(SOM)に統合することで、顧客のハードウェア設計を加速させ、個別コンポーネント方式よりも調達と検証を容易にします。

モデルの効率化が進むにつれ、開発者の関心は、どのモデルが単体で最も高い性能を発揮するかではなく、どこで実行するのが最も合理的かへと移ってきました。

多くの場合、その答えはデバイス上です。エントリー レベルの生成 AI モデルであれば、Jetson Orin Nano 8GB から始めることができます。

大規模な自律型フィジカル AI システムの構築

フィジカル AI システムにおいて、生成 AI モデルは可能性を大きく広げています。

Caterpillar が開発している操縦室内 AI アシスタントである Cat AI Assistant は、音声モデルと言語モデルをローカルで実行し、信頼できるマシン コンテキストと組み合わせることで、オペレーター向けのガイダンス機能と安全機能を支えています。

CES では、Franka Robotics がロボティクスにおけるその実例を示しました。同社のデュアルアーム システム FR3 Duo は NVIDIA GR00T N1.6 モデルを用いて、スクリプトを用意することなく認識から動作までエンドツーエンドにロボット本体上で実行されました。ポリシーもローカルで実行されます。

ロボティクスの研究分野では、NVIDIA の GEAR Lab 発の SONIC プロジェクトが、1 億フレームを超えるモーション キャプチャ データを用いてヒューマノイド用コントローラをトレーニングし、その結果得られたポリシーはロボット本体上に展開されています。キネマティック プランナーは Jetson Orin 上で約 12 ミリ秒/パスで動作し、ポリシー ループは 50Hz で実行されます。すべてがロボット本体上で実行されます。

こうした流れは、開発者コミュニティにも広がっています。イリノイ大学アーバナ シャンペーン校 (UIUC) の SIGRobotics クラブのチームは、GR00T N1.5 モデルを搭載した Jetson Thor 上で、デュアルアームの抹茶作りロボットを開発しました。このロボットは NVIDIA 主催の Embodied AI ハッカソンで優勝しました。

こうした研究の勢いは、ニューヨーク大学 (NYU) の Center for Robotics and Embodied Intelligence にも広がっています。同センターは最近、Jetson Thor を用いて YOR ロボットを稼働させました。AI 駆動の動作に必要な高度な処理は NVIDIA Blackwell コンピューティングが担っています。初期の結果では、YOR はピック & プレイスのような複雑な作業をこなすだけでなく、新しい物体に対する汎化性能やシーン変化に対する堅牢性の向上も示しています。これにより、料理や洗濯といった幅広い家庭内作業への適用準備が加速しています。

独立系研究者も同様の成果を上げています。Hugging Face にてマルチモーダル研究をリードする Andrés Marafioti 氏は、複数のモデルにタスクをルーティングし、自ら作業をスケジューリングするエージェント型 AI システムを Jetson AGX Orin 上で構築しました。ある深夜、このエージェントからこんなメッセージが届きました。「寝てください。朝までにはすべて準備が整います」

Collabnix コミュニティの開発者である Ajeet Singh Raina氏は、NVIDIA Jetson Thor 上で OpenClaw を実行し、24 時間 365 日稼働するパーソナル AI アシスタントを実現する方法を紹介しています。このセットアップにより、ユーザー自身のデータに対してプライベートな大規模言語モデルの推論が可能になり、システムはローカル ゲートウェイを介してメールやカレンダーを管理します。

Jetson が新たな標準に

NVIDIA Jetson は、エッジでオープン モデルを実行するための一般的なプラットフォームとして定着しつつあります。

オープン モデルと AI フレームワークを幅広くサポートし、エッジにおけるほぼすべての生成 AI ワークロードに対応できる柔軟性を開発者に提供します。

Jetson AI Lab では、モデルのベンチマーク結果とオープン モデル コミュニティによるチュートリアルが提供されています。Jetson Thor は、主要な生成 AI モデルすべてにおいて、業界をリードする推論性能を発揮します。

Gemma: Google の Gemini 研究に基づいて構築された Gemma 3 は、Jetson 向けの汎用性の高い主力モデルです。標準でマルチモーダルに対応しており、視覚情報を理解し、140 以上の言語で対話できます。Jetson Thor 上では、128K という大規模なコンテキスト ウィンドウを処理できます。そのため、複雑な手順や複数ステップの指示を記憶する必要のあるロボットに最適です。

gpt-oss-20B: OpenAI が提供するこのモデルは、Jetson Thor と Orin 上でローカルに実行できるモデルで、ほぼ最先端のリーズニング性能を実現します。これにより、高度な AI の導入障壁を下げ、コスト効率の高い推論を可能にします。

Mistral AI: 新しい Mistral 3 オープン モデル ファミリーは、開発者と企業向けに、業界をリードする精度、効率性、カスタマイズ機能を提供します。このファミリーには、3B から 14B までの小型高密度モデルが含まれており、そのサイズに対して高速かつ非常に高性能です。Jetson 開発者は、NVIDIA Jetson Thor 上の vLLM コンテナを使用することで、単一同時実行で毎秒 52 トークン、同時実行数を 8 に増やすことで毎秒 273 トークンまで処理速度を高めることができます。

NVIDIA Cosmos: この最先端のオープンなリーズニング型視覚言語モデルは、ロボットや AI エージェントが人間のように物理世界を認識し、理解し、行動することを可能にします。8B モデルと 2B モデルはどちらも Jetson 上で動作し、高度な時空間認識とリーズニング機能を提供します。

NVIDIA Isaac GR00T N1.6 は、汎用的なロボット スキル向けのオープンな視覚言語アクション (VLA) モデルです。開発者はこれを使用して、周囲の環境を認識し、指示を解釈し、幅広いタスク、環境、形態にわたって行動するロボットを構築できます。Jetson Thor 上では、GR00T N1.6 のパイプライン全体がロボット本体上で実行され、リアルタイムの認識、空間把握、応答性の高いアクションを実現します。

NVIDIA Nemotron: ユーザーが効率的かつ正確な特化型のエージェント AI システムを構築できるようにする、オープン モデル、データセット、テクノロジのファミリーです。高度なリーズニング、コーディング、視覚理解、エージェント型タスク、安全性、音声、情報処理向けに設計されています。Nemotron 3 Nano 9B モデルは、Jetson Orin Nano Super 上で llama.cpp を用いて毎秒 9 トークンの処理速度で効率的に動作します。

PI 0.5: Physical Intelligence が提供する VLA モデルで、ロボットが指示を理解し、高度な汎化性能とリアルタイム適応性を備え、複雑な現実世界のタスクを自律的に実行することを可能にします。NVIDIA Jetson Thor は毎秒 120 アクション トークンの処理速度を実現し、応答性が高く、低レイテンシなフィジカル AI の展開を可能にします。

Qwen 3.5: Alibaba のこのモデル ファミリーは、最新の Qwen 3.5 も含めて、高密度モデルと Mixture of Experts モデルの両方を備え、優れたリーズニング能力、コーディング能力、マルチモーダル理解、長いコンテキストへの対応力を提供します。Jetson Thor は、Qwen 3.5-35B-A3B のようなモデルで毎秒 35 トークンの推論を実現するなど、Qwen モデル全体で最適化された性能を発揮し、リアルタイム対話を可能にします。

開発者は、これらのモデルをファインチューニングすることで、特化型のフィジカル AI エージェントを作成し、フィジカル AI システムにシームレスに展開できます。NVIDIA Jetson プラットフォームは、NVIDIA TRT、Llama.cpp、Ollama、vLLM、SGLang など、広く利用されている AI フレームワークをサポートしています。

Jetson でオープン モデルを活用しよう

開発者は、Hugging Face のチュートリアル (「Deploying Open Source Vision Language Models on Jetson (Jetson 上でオープン ソースの視覚言語モデルを展開)」など) で知識を深めることができます。また、最新のライブストリーム配信もご視聴いただけます。こちらのチュートリアルで学習し、NVIDIA Jetson 上で OpenClaw を実行してみましょう。

3月に開催された GTC 2026 で、NVIDIA は、オープン モデルがデータ センターから物理世界で動作する機械へと移行していく様子を、「Future of Industrial Autonomy (産業の自律化がもたらす未来)」のパネル ディスカッションなどを通じて紹介しました。

Caterpillar の技術ハイライト

- NVIDIA Jetson Thor: 産業システムおよびロボティクス システムでリアルタイム推論を実行できるエッジ AI プラットフォーム

- NVIDIA Riva: Parakeet ASR と Magpie TTS を用いた音声 AI フレームワーク

- Qwen3 4B: 意図解析と応答生成を実現するコンパクトな LLM

- vLLM: エッジにおける LLM 推論処理を可能にする効率的なランタイム

- CatHelios: 信頼できるマシン コンテキストを提供する統合データ プラットフォーム

- NVIDIA Omniverse: 産業ワークフロー向けのデジタル ツインおよびシミュレーション フレームワーク