NVIDIA は、GPU 支援によるハイパフォーマンス コンピューティングと、AI の導入とを促進する取り組みの一環として、NVIDIA GPU Cloud (NGC) で利用可能なコンテナーの数を、昨年の立ち上げ以来 3 倍以上に増やしてきました。

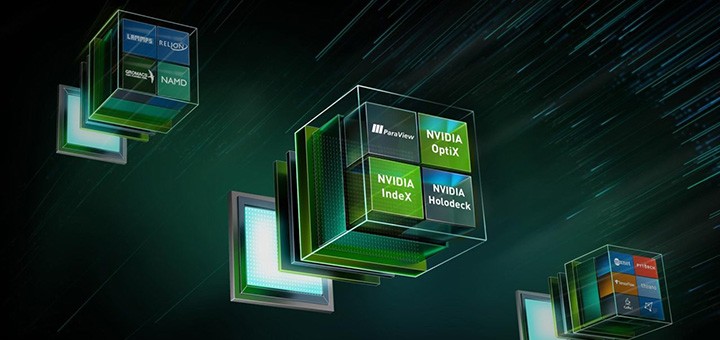

現在、ユーザーはディープラーニング用、ハイパフォーマンス コンピューティング用、ビジュアライゼーション用のコンテナー 35 種を NGC から利用できます。

共有されたクラスタにアプリケーションをデプロイし、仕事の能率を高めるということにおいて、コンテナーはここ 3 年できわめて重要なツールとなりました。特に、AI のワークロードを実行する研究者やデータ サイエンティストにとっては、非常に便利なツールとなっています。

こういったコンテナーにより、ディープラーニング フレームワーク (ディープ ニューラル ネットワークのデザイン、トレーニング、バリデーションに使われる構成要素) をより速く、より簡単にデプロイできるようになりました。

フレームワークのインストールは面倒で、時間のかかる作業です。

コンテナーはこの過程をシンプルにしてくれます。そのおかげで、ユーザーはシンプルな pull コマンドと run コマンドを使って、最新バージョンのアプリケーションにアクセスできます。

デプロイメントの複雑性についての課題は、HPC コンピューティングやビジュアライゼーション用アプリケーションにもそのまま適用できます。

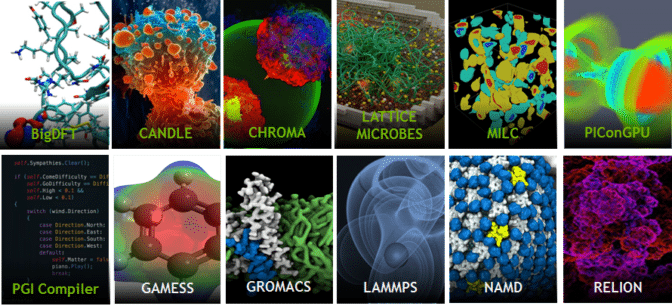

迅速な対応: 新しい NGC コンテナーに含まれる CHROMA、CANDLE、PGI、VMD

昨年 11 月のスーパーコンピューティング会議以来、CHROMA、CANDLE、PGI、VMD を含め、HPC 用とビジュアライゼーション用のコンテナー 9 種が、新たに NGC へ追加されました。この追加前からも、以前のスーパーコンピューティング会議で公開された NAMD、GROMACS、ParaView を含む 8 種のコンテナーが提供されていました。

NGC で利用可能な PGI コンパイラ向けコンテナーは、マルチコア CPU と NVIDIA Tesla GPU を対象にした HPC アプリケーションを作成する際、開発者の助けとなるでしょう。PGI コンパイラと PGI ツールにより、OpenACC、OpenMP、CUDA Fortran による並列プログラミングを利用した HPC アプリケーションも、性能移植性を保ったまま開発できるようになります。

NGC コンテナーの価値を、ユーザーも明らかに感じとっています。NGC コンテナー レジストリにアクセスするため登録を行ったユーザーの数は、現在 27,000 人以上に達しています。

コンテナーが発見を促進

コンテナーが必要というのは、ディープラーニングに限った話ではありません。スーパーコンピューティングにおいても、すべてのセグメントにわたってアプリケーションのデプロイメントをシンプル化することが、非常に強く求められています。というのも、ほとんどのスーパーコンピューティング センターにおいて、アプリケーションをビルドし、デプロイし、立ち上げるために Environment Modules が使われているためです。

このやり方は時間がかかり、非生産的です。数日費やされることもあり、そうなれば、この非生産性はシステム管理者とエンドユーザーの双方に及びます。

スーパーコンピューティングにおいて、こうしたインストール作業が複雑だと、最新機能へのアクセスや、最適化されたパフォーマンスの享受について、ユーザーは制限を受けてしまいます。それがひいては、発見を遅らせることにもつながります。

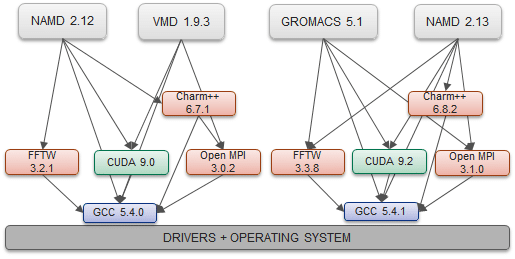

コンテナーがなければアプリケーションの更新は煩雑な作業となる (上図参照)

共有システムへ向けたアプリケーションのデプロイメントもコンテナーによってシンプルに

コンテナーは素晴らしい選択肢を提供し、インストール作業はなくなります。つまり、Environment Modules のリンクを追跡する必要も、それを壊してしまう心配も、一切なくなるということです。

ユーザーはコンテナーを自分で入手し、アプリケーションを数分でデプロイできます。一方、審議会がインストールに同意して実際のプロセスを検討し終わるのをユーザーが待っていたら、数分どころか何日もかかってしまうでしょう。

システム管理者はアプリケーションの修復と保守ではなく、ミッション クリティカルなタスクに集中できるようになりました。

コンテナーのさらなる重要なメリットとして、再現性と移植性がもたらされるという点が挙げられます。ユーザーは、アプリケーションをインストールしなくても、自分のワークロードをさまざまなシステムで実行し、同一のシミュレーション結果を得ることができます。こういった点は、研究論文の発表に向けて結果を検証するとき、特に有用です。

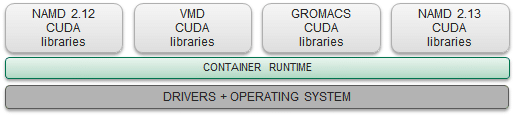

ユーザーはコンテナーを入手/実行するだけでアプリケーションをデプロイできる

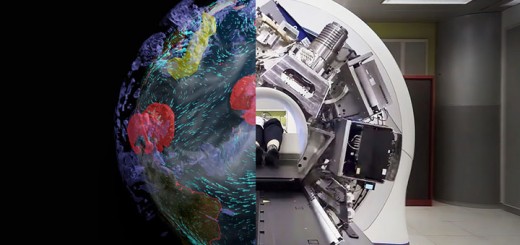

NGC が生産性を後押しし発見を促進

NGC のコンテナーに収められたアプリケーションは GPU によって高速化されており、CPU によるシステムと比べはるかに高いパフォーマンスをもたらします。

ユーザーは最新バージョンの HPC アプリケーションにアクセス可能です。NVIDIA は毎月、ディープラーニング フレームワークをソフトウェア スタック全体にわたって更新し、最適化して、NVDIA の GPU 上における最大限の性能を実現しています。

最後に、以上のようなコンテナーのテスト環境をご紹介します。コンテナーは、スムーズなユーザー エクスペリエンスを目指し、GPU を搭載したワークステーションや NVIDIA DGX System を含むさまざまなシステムでテストされています。また、Amazon Web Service、Google Cloud プラットフォーム、Oracle Cloud Infrastructure などのクラウド サービス プロバイダによりサポートされた NVIDIA の GPU でもテストされています。

Chrome

Chrome Firefox

Firefox Opera

Opera Safari

Safari IE

IE