AI コンテナーの増加に対応すべく、各種のモデル、モデル スクリプト、業界ソリューションを NGC に追加。新たな一連の企業向け NGC 対応サーバーとサポート サービスが GPU で加速した AI の原動力に

科学の発展に、自動運転車の開発に、大量のデータからビジネス上の洞察を得るために、データ サイエンティストや研究者、開発者には GPU の強力なコンピューティング能力が不可欠です。また、適切なソフトウェア ツールも欠かせません。

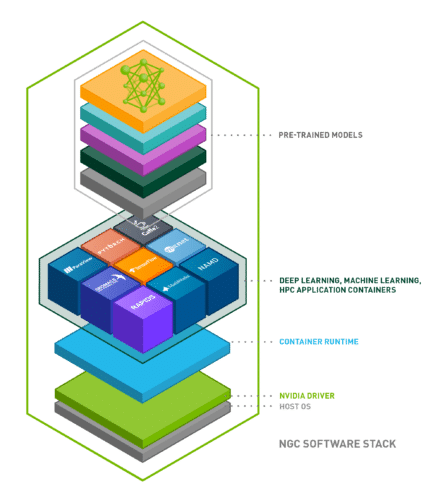

AI は複雑で、モデルの作成に時間がかかりがちです。そこで、複雑な展開とワークフローを簡素化する際に重要な役割を果たすのが、コンテナー技術です。

GTC 2019 では、ディープラーニング、機械学習、HPC などに欠くことのできないソフトウェアのハブとなる NGC を、各種のトレーニング済み AI モデル、モデル トレーニング スクリプト、業界に特化したソフトウェア スタックを追加して大幅に拡充したことを発表しました。

これらの新しいツールによって、ユーザーはスキル レベルにかかわらず AI がもたらす価値をすばやく簡単に得ることができます。

NGC が集中管理を担うことで、ユーザーは本来の業務に専念することが可能に

データ サイエンティストの時間コストは大きく、モデルの開発に要するコンピューティング リソースの需要も高いことから、彼らがエラーを見つけるためだけにフレームワークをソースからコンパイルするのに数時間あるいは数日かかってしまうと、生産性の低下はもとより、減収、ひいては競争力の低下につながります。

そのため、これまでに何千人ものデータ サイエンティストや開発者が、TensorFlow や PyTorch といった、毎月更新される、パフォーマンスが最適化されたディープラーニング フレームワーク コンテナーを NGC から取得してきました。時間のかかる、ミスが発生しやすい展開手順を省き、代わりにソリューションの開発に専念できるためです。

NGC は、コンピューティングの最新トレンドを取り入れたい企業にとっては参入障壁を引き下げる役割を果たし、すでに最新トレンドを取り入れた企業にとってはより大きな価値を早期に実現する役割を果たしています。

トレーニング済みのモデルとトレーニング スクリプトで AI プロジェクトを加速

多くの AI アプリケーションに共通するニーズに、分類、物体の検知、言語の翻訳、テキストから音声への変換、レコメンデーション エンジン、感情分析などがあります。これらの機能を持つアプリケーションやサービスを開発する場合、トレーニング済みのモデルを自社のユース ケースに合わせて調整するほうが、ゼロから始めるよりもずっと早く済みます。

NGC の新しいモデル レジストリは、データ サイエンティストや研究者にきわめて人気の高い AI モデルのリポジトリを提供し、AI アプリケーションの再トレーニングやベンチマーキング、迅速な開発を行うための出発点となります。

NGC の企業アカウント保有者は、ホストされたプライベート レジストリから独自のモデルのアップロード、共有、バージョン管理を複数の組織やチームにまたがって行うこともできます。このモデル レジストリには、https://ngc.nvidia.com/ とコマンド ライン インターフェイスからアクセスできるため、ユーザーはハイブリッド クラウド環境でレジストリを展開して、バージョン管理されたモデルへの制御されたアクセスを組織に提供できます。

また、NGC には、NVIDIA Tensor コアによる混合精度を利用したベスト プラクティスを含むモデル トレーニング スクリプトも用意されています。これにより、旧世代に比べて NVIDIA Turing GPU と Volta GPU のトレーニングや推論におけるパフォーマンスを最大 3 倍にまで高速化できます。

精度と収束のテストが行われた各種のモデルとトレーニング スクリプトを取り揃えることで、NGC は、もっとも重要な NVIDIA のディープラーニング資産の集中管理とキュレーション機能をユーザーに提供します。

医用画像とスマート シティ用のトレーニングおよび展開スタック

業界を越えた効率的なワークフローは、トレーニング済みのモデルから始まり、新たなデータに基づく転移学習トレーニングへと進みます。次に、ネットワークを簡素化して最適化したら、推論を行うためにエッジ デバイスへと展開します。このようなトレーニング済みモデルと転移学習を組み合わせることで、ゼロからの大規模なデータの収集、ラベル付け、モデルのトレーニングにかかる多額のコストを削減して、当該分野の専門家がディープラーニング ワークフローにすばやく取り掛かることができるようになります。

しかしトレーニングや最適化、展開の詳細は、業界によって大幅に異なります。そこで NGC では、スマート シティと医用画像に特化したワークフローの提供を開始しました。

スマート シティについては、ストリーミング分析用の NVIDIA Transfer Learning Toolkit (転移学習ツールキット) に、カメラ映像のフレームからの物体の検知や分類といったインテリジェント ビデオ分析のワークロードに合わせた転移学習機能を搭載しました。再トレーニング、最適化、簡素化が行われたモデルは、スマート シティ用の NVIDIA DeepStream SDK によって NVIDIA Tesla プラットフォームや NVIDIA Jetson プラットフォームに展開されます。

医用画像については、NVIDIA Clara Train SDK を使うことで、医療機関は臓器のセグメンテーション用にあらかじめトレーニングされた MRI スキャン モデルから作業を始め、転移学習を利用してその機関が所有するデータセットに基づきそれらのモデルを向上させることができるようになります。Clara Train によって最適化されたモデルが生成されると、それらのモデルは新たな患者のスキャンにおけるセグメンテーションを向上させるために NVIDIA Clara Deploy SDK によって展開されます。

NGC 対応システム — AI ワークロードに最適化された実証済みのプラットフォーム

世界中の大手システム メーカーから提供されている NGC 対応システムは、NVIDIA によって有効性が実証されています。そのため、データ サイエンティストや開発者は、ディープラーニングや機械学習のワークロードを最適な状態でいち早く開始することができます。

最大のパフォーマンスを発揮するシステムでは、640 個の Tensor コアと最大 32 GB のメモリを搭載した NVIDIA V100 GPU を採用しています。また、稼働率を最大化させるために 新しい NVIDIA T4 GPU を採用したシステムは、機械学習やディープラーニング、仮想デスクトップや HPC など、幅広いワークロードで優れたパフォーマンスを発揮します。詳しくは、実証済みの NGC 対応システムの一覧をご覧ください。

自信を持って AI インフラストラクチャーを展開する

さまざまな業界で AI の導入が急速に進んだ結果、企業の情報システム部門は、多様なユーザーに対応するために新たな種類のワークロードやソフトウェア スタック、ハードウェアをサポートすることになりました。活動の場は変化したものの、システムのダウンタイムを最小限に抑え、ユーザーの生産性を維持することが重要な意味を持つことに変わりはありません。

この課題に対応するために、NVIDIAは「NVIDIA NGC Support Services」 (NGC サポート サービス) を導入しました。NGC 対応システムが最適な状態で実行され、システムの稼働率とユーザーの生産性を最大化できるように、エンタープライズ グレードのサポートを提供します。その一連の新しいサービスによって、企業の情報システム部門は NVIDIA の当該分野の専門家に直接アクセスして、ソフトウェアの問題にすばやく対処し、システムのダウンタイムを最小限に抑えることが可能になります。

NGC サポート サービスは、NGC 対応システムの販売者から提供されます。Cisco からは、同社の実証済みの NGC 対応 NVIDIA V100 システムである Cisco UCS C480 ML 向けに今すぐご利用いただけます。また、HPE からは、実証済みの NGC 対応 NVIDIA T4 サーバーである HPE ProLiant DL380 Gen10 サーバー向けのサービスが 6 月に開始される予定です。その他いくつかの OEM も今後数か月以内にサービスの販売開始を予定しています。

NGC を今すぐお試しください

ngc.nvidia.com では、GPU 搭載システムまたはクラウド インスタンスで取得して実行できる無料の NGC コンテナーやトレーニング済みモデルを提供しています。ぜひお試しください。

※Transfer Learning Toolkit の名称は 2021 年 8 月に TAO Toolkit に変更されました。