NVIDIA DGX SuperPOD は、AI コンピューティングにおける新たな飛躍となる、NVIDIA Rubin プラットフォーム上に構築された大規模システム展開への道を切り開きます。

ラスベガスで開催の CES において、NVIDIA は本日、6 つの新しいチップで構成される Rubin プラットフォームを発表しました。このプラットフォームは、驚異的な AI スーパーコンピューターを実現するように設計され、エージェント型 AI、MoE モデル、そしてロング コンテキスト リーズニングを高速化するように設計されています。

Rubin プラットフォームは、NVIDIA Vera CPU、Rubin GPU、NVLink 6 Switch、ConnectX-9 SuperNIC、BlueField-4 DPU、Spectrum-6 イーサネット スイッチの 6 つのチップを統合し、高度な協調設計アプローチによって、トレーニングを高速化し、推論トークン生成のコストを削減します。

DGX SuperPOD は、企業や研究環境全体に Rubin ベースのシステムを展開するための基盤設計として、今後も活用されます。

NVIDIA DGX プラットフォーム は、NVIDIA コンピューティングからネットワーク、ソフトウェアに至るまで、テクノロジスタック全体を単一の統合システムとして扱い、インフラ統合の負担を軽減し、チームが AI イノベーションとビジネス成果に集中できるようにします。

NVIDIA の創業者/CEO であるジェンスン フアン (Jensen Huang) は、次のように述べています。「トレーニングと推論の両方における AI コンピューティングの需要が急増している今、Rubin はまさに最適なタイミングで登場しました」

AI 産業革命のための新たなプラットフォーム

新しい DGX システムに搭載される Rubin プラットフォーム は、インテリジェンスと効率性を段階的に向上させる 5 つの主要な技術革新を導入しています。

- 第 6 世代 NVIDIA NVLink – 大規模な MoE およびロング コンテキスト ワークロードに向けに、GPU あたり 3.6TB/s、Vera Rubin NVL72 ラックあたり 260TB/s を実現

- NVIDIA Vera CPU – 88 個の NVIDIA カスタム Olympus コア、Armv9.2 との完全な互換性、超高速 NVLink-C2C 接続により、業界をリードする効率的な AI ファクトリー コンピューティングを実現

- NVIDIA Rubin GPU – ハードウェア アクセラレーションによる圧縮機能を備えた第 3 世代 Transformer Engine を搭載し、AI 推論向けに 50 ペタフロップスの NVFP4 コンピューティングを提供

- 第 3 世代 NVIDIA Confidential Computing — Vera Rubin NVL72 は、CPU、GPU、NVLink ドメイン全体でデータ セキュリティを維持する NVIDIA Confidential Computing を実現する初のラックスケール プラットフォーム

- 第 2 世代 RAS エンジン — GPU、CPU、NVLink を網羅する NVIDIA Rubin プラットフォームは、リアルタイムのヘルス モニタリング、耐障害性、予防保全を提供し、ケーブル不要のモジュラー式のトレイにより 18 倍の高速サービスを実現

これらの革新技術を組み合わせることで、前世代との比較でトークンあたりのコストは最大 10 分の 1 に削減されます。これは、AI モデルの規模、コンテキスト、リーズニングの深さが拡大する中で、重要なマイルストーンとなります。

DGX SuperPOD:NVIDIA Rubin スケールアウトの Blueprint

Rubin ベースの DGX SuperPOD 展開では、以下を統合します。

- NVIDIA DGX Vera Rubin NVL72 または DGX Rubin NVL8 システム

- セキュアなソフトウェア デファインド インフラを実現する NVIDIA BlueField-4 DPU

- 次世代推論を実現する NVIDIA Inference Context Memory Storage Platform

- NVIDIA ConnectX-9 SuperNIC

- NVIDIA Quantum-X800 InfiniBand および NVIDIA Spectrum-X イーサネット

- AI インフラのオーケストレーションと運用を自動化する NVIDIA Mission Control

NVIDIA DGX SuperPOD with DGX Vera Rubin NVL72 は、576 基の Rubin GPU を搭載した 8 基の DGX Vera Rubin NVL72 システム を統合し、28.8 エクサフロップスの FP4 パフォーマンスと 600TB の高速メモリを提供します。DGX Vera Rubin NVL72 システムは、36 基の Vera CPU、72 基の Rubin GPU、18 基の BlueField-4 DPU を搭載し、ラック全体でメモリ空間とコンピューティング空間を統合します。260TB/s の NVLink スループットにより、モデルの分割が不要になり、ラック全体を単一のコヒーレント AI エンジンとして動作させることができます。

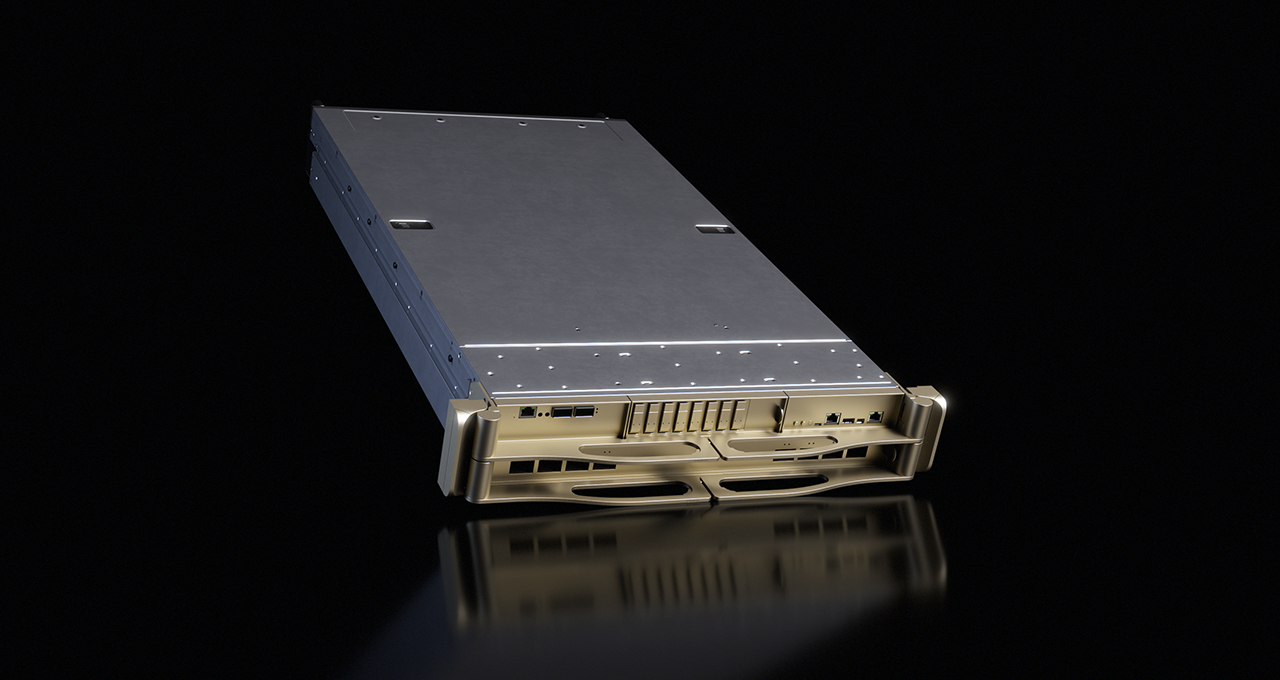

NVIDIA DGX SuperPOD with DGX Rubin NVL8 システムは、512 基の Rubin GPU を搭載した 64 台の DGX Rubin NVL8 システム で構成されます。NVIDIA DGX Rubin NVL8 システムは、x86 CPU を搭載した液冷フォームファクターで Rubin のパフォーマンスを実現し、開発から展開までのあらゆる AI プロジェクトにおいて、組織が Rubin 時代へ効率的に移行できるようにします。8 基の NVIDIA Rubin GPU と第 6 世代 NVLink を搭載した各 DGX Rubin NVL8 は、NVIDIA Blackwell システムと比較して 5.5 倍の NVFP4 FLOPS を実現します。

AI ファクトリー向け次世代ネットワーク

Rubin プラットフォームは、NVIDIA Spectrum-6 イーサネット スイッチ、NVIDIA Quantum-X800 InfiniBand スイッチ、BlueField-4 DPU、ConnectX-9 SuperNIC を搭載した革新的なネットワークにより、データセンターを高性能 AI ファクトリーへと再定義します。これらのネットワークは、世界最大規模の AI ワークロードに対応できるよう設計されています。これらの革新技術を NVIDIA DGX SuperPOD に統合することで、Rubin プラットフォームは、拡張、輻輳、信頼性といった従来のボトルネックを解消します。

大規模クラスター向けに最適化された接続性

次世代の 800Gb/s エンドツーエンド ネットワーク スイートは、AI インフラ向けに 2 つの専用パスを提供し、InfiniBand とイーサネットのどちらを使用しても最高の効率性を保証します。

- NVIDIA Quantum-X800 InfiniBand:専用 AI クラスター向けに業界最小のレイテンシと最高のパフォーマンスを提供します。Scalable Hierarchical Aggregation and Reduction Protocol (SHARP v4) とアダプティブ ルーティングを活用し、コレクティブ オペレーションをネットワークにオフロードします。

- NVIDIA Spectrum-X イーサネット:Spectrum-6 イーサネット スイッチとConnectX-9 SuperNIC を基盤とするこのプラットフォームは、標準イーサネット プロトコルを使用して、AI ファクトリーに予測可能な高性能なスケールアウトおよびスケール アクロス接続を提供します。A Iワークロードの「East-West」トラフィック パターンに特化して最適化されています。

ギガワット AI ファクトリーの構築

これらの技術革新は、Rubinプラットフォームとの緊密な協調設計を体現しています。輻輳制御とパフォーマンス分離を極めることで、NVIDIA は次世代のギガワット AI ファクトリーへの道を切り開きます。この包括的なアプローチにより、AI モデルの複雑さが増しても、AI ファクトリーのネットワーク ファブリックは、制約ではなく、速度を促進する触媒として機能します。

NVIDIA ソフトウェアが AI ファクトリーの運用と展開を促進

NVIDIA Blackwell ベースの DGX システム向けの AI データセンター運用およびオーケストレーション ソフトウェアである NVIDIA Mission Control が、Rubin ベースの NVIDIA DGX システムでも利用可能になり、企業はインフラの管理と運用を自動化できるようになります。

NVIDIA Mission Control は、展開の構成から施設との統合、クラスターやワークロードの管理まで、インフラ運用のあらゆる側面を高速化します。

インテリジェントな統合ソフトウェアにより、企業は NVIDIA Rubin の冷却および電源イベントの制御を強化し、インフラのレジリエンスを高めることができます。NVIDIA Mission Control は、迅速なリーク検出による迅速な対応、NVIDIA の最新の効率化イノベーションへのアクセス、自律的な復旧による AI ファクトリーの生産性の最大化を実現します。

NVIDIA DGX システムは、NVIDIA Nemotron-3 ファミリーのオープン モデル、データ、ライブラリなどの NVIDIA NIM マイクロサービスを含む、NVIDIA AI Enterprise ソフトウェア プラットフォームもサポートしています。

DGX SuperPOD:産業用AIの未来

DGX SuperPOD は長年にわたり、大規模 AI インフラの Blueprint として機能してきました。Rubin プラットフォームの登場は、新世代の AI ファクトリーの出発点となります。このシステムは、数千ステップにわたるリーズニングを行い、大幅に低コストでインテリジェンスを提供するように設計されており、組織が次世代のフロンティア モデル、マルチ モーダル システム、エージェント型 AI アプリケーションを構築するのに役立ちます。

NVIDIA DGX SuperPOD と DGX Vera Rubin NVL72 または DGX Rubin NVL8 システムは、今年後半に提供開始予定です。

ソフトウェア製品情報については、利用規約をご覧ください。