大規模言語モデル (LLM) ベースの AI アシスタントは、生産性向上のための強力なツールですが、適切な文脈と情報がない場合、ニュアンスと関連性の高い回答を提供することが困難になることがあります。ほとんどの LLM ベースのチャット アプリでは、ユーザーが文脈としていくつかのファイルを提供できますが、ユーザーの PC 内のスライド、ノート、PDF、画像などに埋もれた情報すべてにアクセスできない場合が多くあります。

Nexa.ai の Hyperlink は、この課題に対処するローカル AI エージェントです。数千のファイルを迅速にインデックス化し、ユーザーの質問の意図を理解し、文脈に合わせた洞察を提供します。

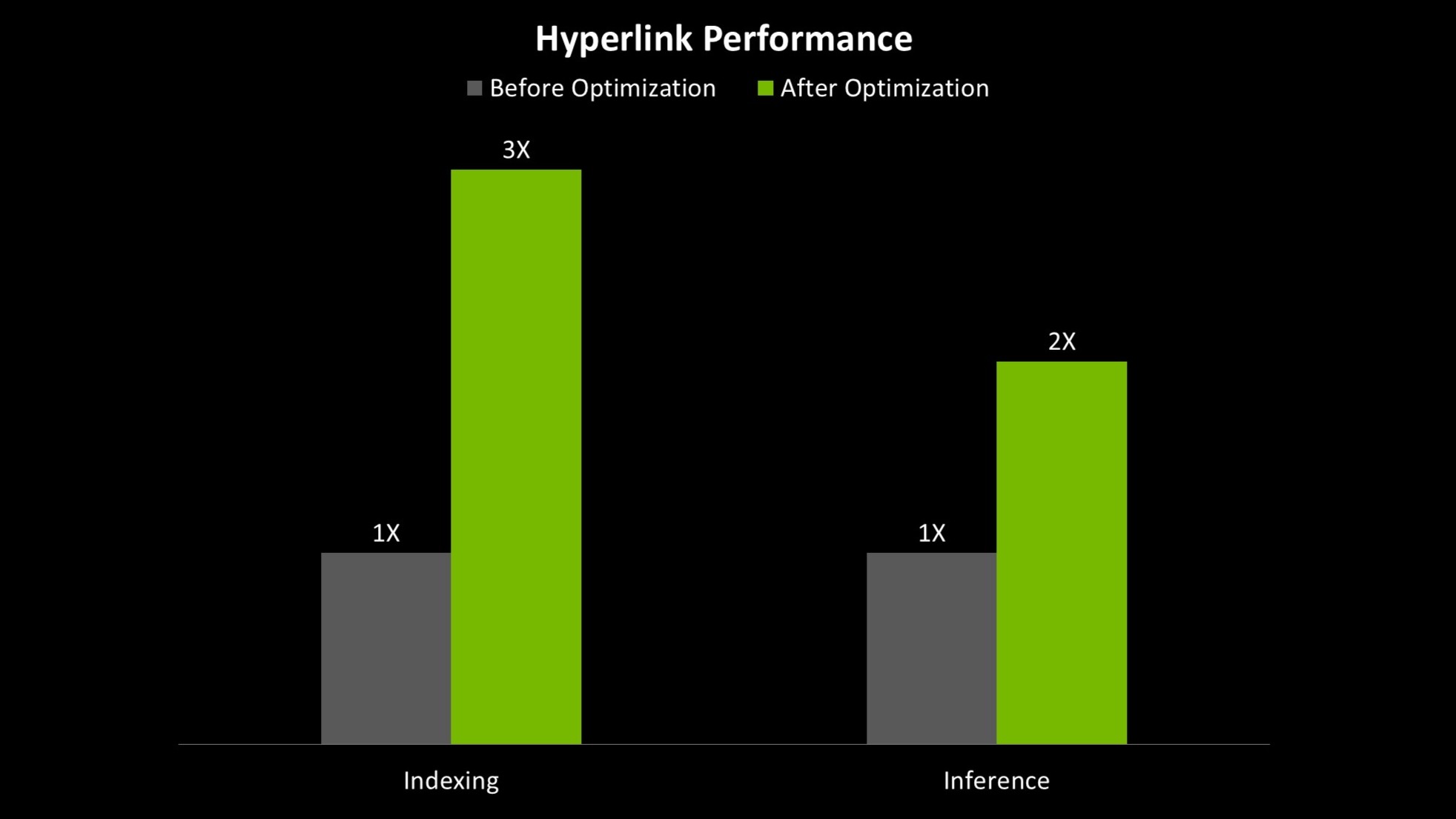

本日公開されたアプリの最新バージョンには、NVIDIA RTX AI PC での高速化が含まれています。これにより、RAG のインデックス作成速度が 3 倍向上します。たとえば、以前はインデックス作成に 15 分近くかかっていた膨大な内容の 1GB のフォルダーを、わずか 4 ~ 5 分で検索可能になります。さらに、LLM 推論が 2 倍に高速化され、ユーザーのクエリへの応答が迅速になります。

ローカル データを瞬時にインテリジェンスに変える

Hyperlink は、生成 AI を使用して数千ものファイルから適切な情報を探します。また、単にキーワードを照合するのではなく、ユーザーのクエリの意図と文脈も理解します。

これを行うために、小さなフォルダーからコンピューター上のあらゆるファイルまで、ユーザーが指定したすべてのローカル ファイルの検索可能なインデックスが作成されます。ユーザーは、自然言語で探している内容を記述し、ドキュメント、スライド、PDF、画像など、多様な形式の関連コンテンツを検索することができます。

たとえば、ユーザーが「2 つの小説のテーマを比較する SF 読書感想文」について支援を求めた場合、Hyperlink は、たとえそれが「Lit_Homework_Final.docx」という名前のファイルに保存されている場合でも、関連情報を見つけることができます。

検索と RTX で高速化された LLM のリーズニング機能を組み合わせることで、Hyperlink はユーザーのファイルから得た洞察に基づいて質問に回答します。複数の情報源にわたるアイデアを結び付け、文書間の関係を識別し、明確な引用元がある論理的な回答を生成します。

すべてのユーザー データはデバイスに留まり、プライバシーが確保されます。つまり、個人のファイルがコンピューター外に流出することはないため、機密情報がクラウドに送信される心配もいりません。強力な AI の恩恵を受けられ、管理や安心感を犠牲にすることはありません。

Hyperlink は、すでに専門家、学生、クリエイターが採用しています。

- 会議の準備: ノートや議事録で重要な議論の要点を要約します。

- レポートの分析: 業界レポート全体から重要なデータ ポイントを引用し、綿密に調査された回答を得ることができます。

- コンテンツの作成: 長年にわたり保存されてきたノートや下書きから、文章や動画のアイデアを集めます。

- よりスマートな学習: テスト前の追い込み、講義ノート、スライド、チュートリアルをすべて一度に検索しながら、重要なコンセプトを確認できます。

- 領収書の整理: スキャンしたドキュメントを分類し、経費報告書を自動的に作成します。

- より高速なデバッグ: ドキュメントとコード内のコメントを検索し、エラーやバージョンの競合を解決します。

Hyperlink アプリをダウンロードして、RTX PC で AI 検索を試してみましょう。

Facebook、Instagram、TikTok、X で NVIDIA AI PC をフォローし、RTX AI PC ニュースレターを購読して、最新情報を入手しましょう。LinkedIn と X で NVIDIA Workstation をフォローしてください。

ソフトウェア製品情報に関する利用規約をご覧ください。