過去最大の GTC カンファレンスがキックオフ、NVIDIA創業者/CEOのジェンスン フアン (Jensen Huang) が、NVIDIA Blackwell、NIM マイクロサービス、Omniverse Cloud API などを発表。

生成 AI は、それが関わるすべての産業に革命をもたらすでしょう。必要なのは、この課題に対応するためのテクノロジだけです。

NVIDIA の創業者/CEO であるジェンスン フアン (Jensen Huang) は月曜日、そのテクノロジ、つまり新しい Blackwell コンピューティング プラットフォームを披露し、コンピューティング能力の向上がソフトウェアからサービス、ロボティクス、メディカル テクノロジなどあらゆるものにもたらす大きな進歩について概説しました。

「アクセラレーテッド コンピューティングは転換期に到達し、汎用コンピューティングは限界を迎えています」と、シリコンバレーの洞窟に似た SAP センターのアリーナで、基調講演に集まった 11,000 人以上の GTC 参加者 (と数万人以上のオンライン参加者) を前に語りました。

「コンピューティングの規模を拡大し続け、コストを削減し、持続可能でありながら、ますます多くのコンピューティングを消費し続けるためには、別の方法が必要です。アクセラレーテッド コンピューティングは、あらゆる産業を汎用コンピューティングよりも劇的に高速化するものです」

まぶしい春の日に、サンノゼ コンベンション センターからアリーナまで 20 分かけて一緒に歩いてきた CEO や開発者、AI 愛好家や起業家たちで埋め尽くされた会場で、フアンは高さ 40 フィート、テニスコートほどの大きさの 8K スクリーンに映し出された巨大な画像の前に立ち、大勢の聴衆の前で話しました。

世界の AI インフラに大規模なアップグレードをもたらすため、フアンは、1 兆パラメータ規模の大規模言語モデル上でリアルタイムの生成 AI を展開する NVIDIA Blackwell プラットフォームを発表しました。

NVIDIA NIM は、NVIDIA 推論マイクロサービスのことで、あらゆる種類のカスタム AI を展開するために、開発者と何億もの GPU をつなぐソフトウェアをパッケージ化して提供する新しい方法です。

また、AI を物理的な世界にもたらすために、フアンは高度なシミュレーション機能を提供する Omniverse Cloud API を紹介しました。

フアンは、これらをパワフルなデモ、世界最大級の企業とのパートナーシップを交えて紹介し、自身のビジョンを詳述する 20 以上の発表を行いました。

15 年の間に、地元のホテルのボールルームから、世界で最も重要な AI カンファレンスへと成長した GTC が、 5 年ぶりにリアル イベントとして戻ってきました。

今年は、フアンがモデレーターを務め、Transformer を開発した 8 人のパイオニアとの Transformer をテーマとしたパネル ディスカッションを含む 900 以上のセッション、300 以上の展示、20 以上の技術ワークショップが行われました。

AI とあらゆるものが交差するイベントです。基調講演の見事なオープニング アクトでは、世界リードする AI アーティストの Refik Anadol 氏が、緑、青、黄、赤の波のような渦が、スクリーン上でぶつかり、ねじれ、そしてほどけるリアルタイムに動く巨大なAI データ彫刻を披露しました。

講演の冒頭でフアンは、異なるモデルによって扱われる多様なデータ タイプを処理できるマルチモーダル AI の台頭が、AI により高い適応性とパワーを与えていると説明しました。パラメータを増やすことで、これらのモデルはより複雑な解析を扱うことができます。

しかし、これは同時にコンピューティング パワーの必要性が大幅に高まることを意味します。そして、このような協調的なマルチモーダル システムが、1 兆ものパラメーターを持つような複雑なものになるにつれて、高度なコンピューティング インフラストラクチャへの要求が強まります。

「さらに大規模なモデルが必要になります。インターネット上のテキストだけでなく、マルチモダリティのデータを使ってトレーニングします。テキストや画像、グラフやチャートを使ってトレーニングします。私たちはテレビを見て学んだように、ビデオを見ることも多くなるでしょう」

次世代のアクセラレーテッド コンピューティング

つまり、「より大きな GPU が必要です」とフアンは言いました。Blackwell プラットフォームは、この課題に応えるために構築されています。フアンはポケットから Blackwell チップを取り出し、Hopper チップと並べて掲げました。

ゲーム理論と統計学を専門とするカリフォルニア大学バークレー校の数学者であり、黒人として初めて米国科学アカデミー会員に選ばれた David Harold Blackwell 氏にちなんで名づけられたこの新しいアーキテクチャは、2 年前に発売された NVIDIA Hopper アーキテクチャの後継となるものです。

Blackwell は、チップあたり、トレーニング用の FP8 で前世代の 2.5 倍、推論用の FP4 で 5 倍の性能を発揮します。第 5 世代の NVLink インターコネクトは Hopper の 2 倍高速で、最大 576 基のGPU にスケールアップできます。

また、NVIDIA GB200 Grace Blackwell Superchip は、2 つの Blackwell NVIDIA B200 Tensor コア GPU を、900 GB/秒の超低消費電力 NVLink チップ間インターコネクトを介して NVIDIA Grace CPU に接続します。

フアンは、システムのボードを掲げてこう言いました。「このコンピュータは、この小さなスペースにこれだけのコンピューティングを詰め込んだ初めてのコンピュータです。メモリがコヒーレントなので、彼らは 1 つのアプリケーションに一緒に取り組んでいる 1 つの大きな幸せな家族のようにも感じられます」。

最高の AI パフォーマンスを実現するために、GB200 を搭載したシステムは、本日発表された最大 800Gb/秒のスピードのネットワーキングを提供する NVIDIA Quantum-X800 InfiniBand および Spectrum-X800 Ethernet プラットフォームと接続することができます。

「私たちが節約できるエネルギーの量、節約できるネットワーク帯域幅の量、節約できる時間の量は、途方もないものになるでしょう。未来はジェネレーティブです。だからこそ、これは全く新しい産業なのです。私たちのコンピューティングの方法は根本的に異なります。私たちは生成 AI 時代のためのプロセッサを作ったのです」。

Blackwell をスケールアップするために、NVIDIAは NVLink Switch と呼ばれる新しいチップを作りました。それぞれ毎秒 1.8 テラバイトで 4 つの NVLink インターコネクトを接続でき、ネットワーク内削減を行うことでトラフィックを排除します。

NVIDIA Switch と GB200 は、フアンが「1つの巨大な GPU」と表現した NVIDIA GB200 NVL72 の主要コンポーネントであり、Blackwell を活用して 1 兆パラメータ モデル向けの超高速コンピュートを提供するマルチノード、液冷、ラックスケールのシステムです。

「このマシンは 60 万個のパーツを搭載し、重量は 3,000 ポンド (約 1.36トン) です。そしてこれは、1 つのラックに収められたエクサフロップ AI システムです。では、その裏側を見てみましょう」。

さらに、NVIDIA は本日、NVIDIA GB200 Grace Blackwell Superchip を搭載した 次世代 AI スーパーコンピューターである NVIDIA DGX SuperPOD を発表しました。このスーパーコンピューターは、超大規模な生成 AI のトレーニングおよび推論ワークロード向けに、1 兆パラメータ モデルを常時稼働で処理します。

新しい高効率の液冷式ラックスケール アーキテクチャを採用した新しい DGX SuperPOD は、NVIDIA DGX GB200 システムで構築され、FP4 精度で 11.5 エクサフロップスの AI スーパーコンピューティングと 240 テラバイトの高速メモリを提供します。ラックを追加すれば、さらに拡張できます。

「将来、データセンターは AI ファクトリーとして考えられるようになるでしょう。データセンターの目的は収入を生み出すことですが、この場合は知性を生成することです」

業界はすでに Blackwell を採用しています。

Blackwell を発表したプレス リリースには、Alphabet と Google のCEO の Sundar Pichai 氏、Amazon のCEO Andy Jassy 氏、Dell の CEO Michael Dell 氏、Google DeepMind の CEO Demis Hassabis 氏、Meta の CEO Mark Zuckerberg 氏、Microsoft の CEO Satya Nadella 氏、OpenAI の CEO Sam Altman 氏、Oracle の会長 Larry Ellison 氏、Tesla と xAI の CEO Elon Musk 氏の推薦が含まれています。

Blackwell は、世界中の主要なクラウド サービス プロバイダー、先駆的な AI 企業、システム ベンダー、サーバー ベンダー、そして地域のクラウド サービス プロバイダーや通信事業者によって採用されています。

「業界全体が Blackwell のために準備を進めています」とフアンは述べ、NVIDIA 史上最も成功したローンチとなるだろうと語りました。

ソフトウェアを作る新しい方法

生成 AI は、アプリケーションの書き方を変えるとフアンは言います。

ソフトウェアを書くのではなく、企業が AI モデルを組み立て、彼らにミッションを与え、作業成果物の例を示し、計画と中間結果をレビューするようになると説明しました。

これらのパッケージ (NVIDIA NIM) は、NVIDIA のアクセラレーテッド コンピューティング ライブラリと生成 AI モデルから構築される、とフアン氏は説明します。

「私たちは将来、どのようにソフトウェアを構築するのでしょうか?ゼロから書いたり、Python のコードを大量に書いたりすることは、まずないでしょう。AI チームを編成する可能性が非常に高いのです」

マイクロサービスは業界標準の API をサポートしているため、接続が容易で、NVIDIA の大規模な CUDA インストール ベース全体で動作し、新しい GPU 用に再最適化され、セキュリティの脆弱性や暴露について常にスキャンされます。

フアンは、顧客は NIM マイクロサービスをそのまま利用することもできるし、NVIDIA が独自の AI やコパイロットの構築を支援し、特定の企業しか知らない専門的なスキルをモデルに教え、非常に価値のある新サービスを生み出すこともできると述べました。

「エンタープライズ IT 業界は金鉱の上に座っているようなものです」とフアンは言います。「何年もかけて作られた素晴らしいツール (とデータ) があります。その金鉱をコパイロットに変えることができれば、このコパイロットが私たちの仕事を助けてくれるでしょう」

大手テック企業はすでにそれを実用化しています。フアンは、NVIDIA がすでに Cohesity、NetApp、SAP、ServiceNow、Snowflake のコピロットとバーチャル アシスタントの構築を支援していることを明らかにました。そして、産業界も同様に参入しています。

通信分野では、次の通信時代を推進するための生成 AI と Omniverse を搭載したプラットフォームである NVIDIA 6G Research Cloud を発表しました。これは、NVIDIA の Sionna ニューラル無線フレームワーク、NVIDIA Aerial CUDA アクセラレーテッド無線アクセス ネットワーク、NVIDIA Aerial Omniverse Digital Twin for 6G で構築されています。

半導体設計、製造では、TSMC および Synopsys と共同で、NVIDIA が画期的なコンピュテーショナル リソグラフィ プラットフォームの cuLitho を製品化すると発表しました。このプラットフォームは、半導体製造において最も計算負荷の高いワークロードを 40~60 倍高速化します。

フアンはまた、NVIDIA Earth Climate Digital Twin も発表しました。現在利用可能なこのクラウド プラットフォームは、気候気象予測を加速させるインタラクティブな高解像度シミュレーションを可能にします。

AI が最も大きな影響を与えるのはヘルスケア分野であるとフアンは述べ、NVIDIA はすでに画像処理システム、遺伝子配列決定装置に取り組んでおり、主要な手術ロボット企業と協業していると説明しました。

NVIDIA は新しいタイプの生物学ソフトウェアを発表しました。NVIDIA は本日、世界中のヘルスケア企業が、どこからでも、どのクラウド上でも、生成 AI の最新の進歩を活用できるようにする 20 以上の新しいマイクロサービスを発表しました。これらのマイクロサービスは、高度な画像処理、自然言語および音声認識、デジタル生物学の生成、予測、シミュレーションを提供します。

Omniverse は AI を物理的世界にもたらす

AI の次の波は、物理的な世界について学習する AI になるだろう、とフアンは言います。

「ロボットのために世界をデジタルで表現するシミュレーション エンジンが必要です。そのために、ロボットがロボットになる方法を学ぶためのジムが必要です。私たちはその仮想世界を Omniverse と呼んでいます」。

そのため、NVIDIA は本日、NVIDIA Omniverse Cloud を API として提供し、ソフトウェア メーカーのエコシステム全体にわたって、産業用デジタルツイン アプリケーションとワークフローを作成するための世界をリードするプラットフォームのリーチを拡大すると発表しました。

5 つの新しい Omniverse Cloud アプリケーション プログラミング インターフェースにより、開発者は Omniverse のコア技術を、デジタル ツイン用の既存の設計、自動化ソフトウェア アプリケーションや、ロボットや自動運転車のような自律型マシンをテスト、検証するためのシミュレーション ワークフローに直接簡単に統合することができます。

これがどのように機能するかを示すために、フアンは、マルチカメラによる知覚と追跡を使用したロボティック倉庫のデモにて、作業員を見守り、ロボティク スタックをフル稼働させて自律走行しているロボティック フォークリフトを指揮している様子を披露しました。

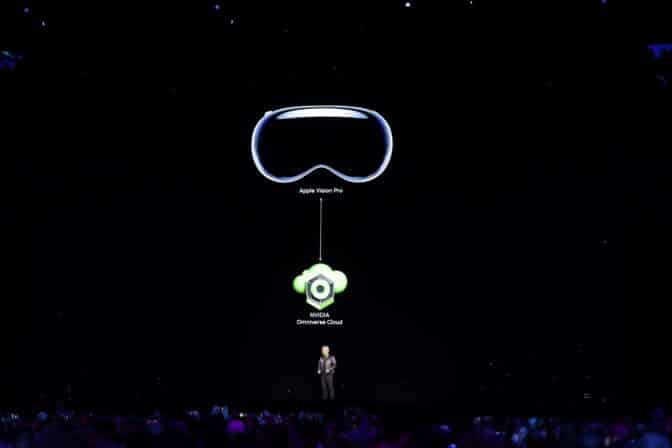

フアンはまた、NVIDIA が Omniverse を Apple Vision Pro に導入し、新しい Omniverse Cloud API によって、開発者がインタラクティブな産業用デジタルツインを VR ヘッドセットにストリーミングできるようにすることも発表しました。

Ansys、Cadence、3DEXCITE ブランドの Dassault Systèmes、Hexagon、Microsoft、Rockwell Automation、Siemens、Trimble など、世界最大の産業用ソフトウェア メーカーが Omniverse Cloud API を採用しています。

ロボティクス

動くものはすべてロボットになる、とフアンは言います。自動車産業はその大きな部分を占めるでしょう。NVIDIA のコンピュータは、すでに自動車、トラック、配送ロボット、ロボット タクシーに搭載されています。

フアンは、世界最大の自動運転企業である BYD が、同社の AV にNVIDIA の次世代コンピュータを採用し、DRIVE Thor 上に次世代 EV フリートが構築されていることを発表しました。

また、ロボットが周囲の状況をよりよく認識できるように、最先端のマルチカメラ ビジュアル オドメトリ、3D 再構成および占有マップ、深度知覚を備えた Isaac Perceptor ソフトウェア開発キットも発表しました。

また、マニピュレータ (ロボット アーム) の適応性を高めるために、NVIDIA は、最先端のロボット アーム知覚、パス プランニング、およびキネマティック制御ライブラリである Isaac Manipulator を発表しました。

最後にフアンは、ロボティクスとエンボディド AI におけるブレイクスルーを推進する NVIDIA の取り組みをさらに促進するために、ヒューマノイド ロボット用の汎用基盤モデルである Project GR00T を発表しました。

この取り組みを支援するために、フアンは、NVIDIA Thor システムオンチップをベースにしたヒューマノイド ロボット用の新しいコンピュータ Jetson Thor と、NVIDIA Isaac ロボティクス プラットフォームの大幅なアップグレードを発表しました。

講演終了間際、フアンは、Disney Research の NVIDIA を搭載した 2 台の小型ロボットをステージに上げました。

「NVIDIA はまさに、コンピュータ グラフィックス、物理学、人工知能の交差点です。この瞬間、そのすべてが実を結びました」